مفهوم «چاقی هوش مصنوعی» به خطرات وابستگی بیش از حد به هوش مصنوعی اشاره دارد. وقتی سرعت و کارایی را به تفکر و تعقل ترجیح میدهیم، مهارتهای تفکر نقادانه ما ممکن است دچار زوال شود. در این مقاله، سیر تکامل مدلهای زبان (LLMs)، محدودیتهای آنها، و اهمیت حفظ مهارتهای تفکر نقادانه در عصر هوش مصنوعی بررسی میشود.

درک چاقی هوش مصنوعی و تبعات آن

اصطلاح «چاقی هوش مصنوعی»، که توسط پاسکال بورنت در کتاب خود Irreplaceable: The Art of Standing Out in the Age of Artificial Intelligence مطرح شده است، به رکود ذهنی ناشی از اتکای بیرویه به هوش مصنوعی اشاره دارد. چاقی هوش مصنوعی، همانند چاقی فیزیکی ناشی از مصرف بیش از حد غذاهای آماده، زمانی بروز میکند که سرعت و سهولت بر نیاز به تعمق و تحلیل سایه میافکند. بورنت هشدار میدهد که اعتیاد به «خلاقیت سریع» میتواند به تحلیل رفتن تفکر نقادانه منجر شود و افراد را به جای جستجوی کمال، به سمت راهحلهای «مطلوب» سوق دهد.

تفکر نقادانه چیست؟

تفکر نقادانه شامل داوریهای روشن و مستدل مبتنی بر تفسیر، فهم و تلفیق شواهد است. این امر مستلزم تحلیل منابع متنوع و استنتاج منطقی است. هنگام تعامل با ابزارهای هوش مصنوعی، تفکر نقادانه نقشی حیاتی در ارزیابی خروجیها و سنجش اعتبار آنها به جای پذیرش بیچون و چرای آنها ایفا میکند.

سیر تکامل مدلهای زبان (LLMs)

تاریخچه مدلهای زبان به سال ۱۸۸۳ بازمیگردد، زمانی که میشل برآل مفهوم معناشناسی را معرفی کرد و شالوده درک ساختار و ارتباطات درون زبانها را بنا نهاد. در طول دههها، پیشرفتها در پردازش زبان طبیعی (NLP: Natural Language Processing) و یادگیری ماشین منجر به جهشهای چشمگیری شده است:

- ۱۹۴۵–۱۹۵۰: پژوهشهای اولیه NLP با پروژههای ترجمه ماشینی مانند آزمایش Georgetown-IBM و کار پیشگامانه آرتور ساموئل در زمینه یادگیری ماشین آغاز شد.

- ۱۹۶۶: ELIZA، اولین برنامه NLP قادر به مکالمه شبهانسانی، از فنون تطبیق الگو برای شبیهسازی فهم استفاده میکرد، اگرچه فاقد تواناییهای استدلال واقعی بود.

- ۱۹۹۰–۲۰۰۰: ابزارهایی مانند N-Grams، شبکههای عصبی بازگشتی (Recurrent Neural Networks) و مترجم گوگل قابلیتهای تحلیل متن و ترجمه را بهبود بخشیدند. Siri اپل در سال ۲۰۱۱ راهاندازی شد که نشانگر ظهور دستیاران هوش مصنوعی بود.

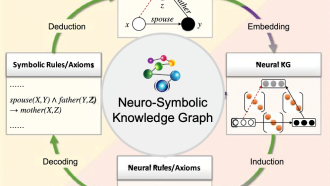

- ۲۰۱۷: معرفی معماری Transformer توسط گوگل با امکان درک بهتر سیاق کلام، انقلابی در NLP ایجاد کرد. این امر منجر به مدلهای از پیش آموزشدیده مانند GPT و BERT شد.

- ۲۰۱۹–۲۰۲۲: GPT-2 و GPT-3 شرکت OpenAI تولید متن را ارتقا دادند، در حالی که ChatGPT به عنوان نقطه عطفی در هوش مصنوعی مکالمهای ظهور کرد. انتشار GPT-4 خلاقیت، ورودی بصری و استدلال چندمرحلهای را تقویت کرد.

با وجود این پیشرفتها، LLMها مانند GPT-4 هنوز به دلیل اتکای آنها به مدلهای پیشبینی کلمه بعدی و فقدان منطق مختص هر حوزه، در استدلال نقادانه ضعف دارند.

نقش زمینه در عملکرد LLM

یک محدودیت اساسی LLMها در پنجره زمینهای آنها نهفته است – میزان اطلاعاتی که یک مدل هوش مصنوعی میتواند همزمان پردازش کند. در حالی که پنجرههای زمینهای بزرگتر امکان پاسخهای آگاهانهتری را فراهم میکنند، با افزایش بار محاسباتی همراه هستند. با این حال، حتی با بهبود در اندازه زمینه، LLMها با درک ظرایف انسانی، زیرمتن فرهنگی و حافظه بلندمدت مشکل دارند.

به عنوان مثال، وقتی پرسیده میشود: «۹.۱۱ و ۹.۲ – کدام بزرگتر است؟» ChatGPT ممکن است به اشتباه پاسخ دهد زیرا در در نظر گرفتن منظور یا زمینه کاربر ناکام میماند. این امر اهمیت نظارت انسانی و ارزیابی نقادانه را هنگام تفسیر خروجیهای تولید شده توسط هوش مصنوعی برجسته میکند.

آیا LLMها میتوانند تفکر نقادانه را تقویت کنند؟

در حالی که LLMها فاقد خودآگاهی و ابتکار عمل هستند، میتوانند به عنوان ابزاری برای ایدهپردازی و اصلاح ایدهها عمل کنند. برای مثال:

- محرک خلاقیت: نویسندگانی که دچار انسداد ذهنی شدهاند میتوانند از LLMها برای تولید انگیزه یا ایده استفاده کنند.

- مکانیسمهای بازخورد: دانشآموزان میتوانند با درخواست بازخورد هوش مصنوعی در مورد ساختار و شواهد، مقالات خود را بهبود بخشند.

با این حال، تفکر نقادانه فراتر از تولید و اصلاح ایده است. این شامل زیر سوال بردن پیشفرضها، تحلیل شواهد و ساختن استدلالهای معنادار است – حوزههایی که LLMهای فعلی در آنها نقص دارند.

اجتناب از چاقی هوش مصنوعی: مسیر پیش رو

برای کاهش مخاطرات چاقی هوش مصنوعی، افراد و سازمانها باید بین استفاده از ابزارهای هوش مصنوعی و حفظ مهارتهای تفکر نقادانه تعادل برقرار کنند. برخی از راهبردها عبارتند از:

- استفاده آگاهانه از هوش مصنوعی: از هوش مصنوعی به عنوان مکمل و نه جایگزین فرآیندهای فکری انسان استفاده کنید.

- آموزش: موسساتی مانند دانشگاه نیوکاسل در حال توسعه منابعی مانند چک لیست هستند تا به دانشآموزان کمک کنند در عصر هوش مصنوعی به طور نقادانه بیندیشند.

- دستورات پیشرفته: ایجاد دستورات سنجیده میتواند خروجیهای هوش مصنوعی را بهبود بخشد و در عین حال تعامل عمیقتر با موضوع را تشویق کند.

- آگاهی اخلاقی: توجه داشته باشید که هوش مصنوعی فاقد ارزشهای اخلاقی است و ممکن است پاسخهای «متعارف» بدون استدلال دقیق یا ملاحظات اخلاقی ارائه دهد.

نکات پایانی

ابزارهای هوش مصنوعی انقلابی در بهرهوری و خلاقیت ایجاد کردهاند، اما نمیتوانند جایگزین داوری انسانی یا تفکر نقادانه شوند. همانطور که بورنت هشدار میدهد، ما نباید اجازه دهیم هوش مصنوعی تمام وظایف خلاقانه یا فرآیندهای تصمیمگیری را به عهده بگیرد. در عوض:

- در مورد محدودیتهای هوش مصنوعی، از جمله ناتوانی آن در درک ظرایف انسانی یا انطباق با زمینههای در حال تغییر، تأمل کنید.

- منابع و اعتبار اطلاعات تولید شده توسط هوش مصنوعی را بررسی کنید.

- با ترکیب نقاط قوت هوش مصنوعی با نبوغ انسانی برای رسیدن به کمال تلاش کنید.

با پرورش فرهنگ تفکر نقادانه، میتوانیم از مزایای هوش مصنوعی بهرهمند شویم و در عین حال از دامهای اتکای مفرط اجتناب کنیم – گامی حیاتی در ساختن آیندهای که در آن انسانها و هوش مصنوعی به طور هماهنگ با هم زیست میکنند.

اگر به خواندن کامل این مطلب علاقهمندید، روی لینک مقابل کلیک کنید: medium