احتمالاً تا حالا شنیدی که توی سیلیکون ولی (همین جایی که همه شرکتای بزرگ تکنولوژی جمع شدن) یه عده فکر میکنن آیندهمون طوریه که هوش مصنوعی (AI یعنی همین برنامههای باهوشی که خودشون یاد میگیرن و تولید محتوا میکنن) میتونن حتی نقش روانشناس و مشاور رو برامون بازی کنن! یعنی میلیونها نفر بدون نیاز به روانشناس آدم – با درس خوندنای سخت و بیمه و اینجور داستانا – فقط برن سراغ یه چتبات مثل ChatGPT و درد دل کنن! اما بیای بریم سراغ چیزی که واقعاً داره اتفاق میفته…

چند وقت پیش یه داستان جالب منتشر شد که واقعاً بامزّه بود! ماجرا این بود که یه سری آدم فهمیدن مشاور یا روانشناسشون یواشکی داره وسط جلسههای مشاوره از ChatGPT کمک میگیره. مثلاً یه مورد خیلی بانمک: طرف توی جلسه آنلاین بود که یهو روانشناسش تصادفاً صفحهی دسکتاپش رو شیر میکنه و مریض میبینه همونجا روانشناس داره حرفای خودش رو به ChatGPT مینویسه تا چتبات جواب و راهکار بده و اون دوباره همونا رو به مریضش بگه! یعنی دقیقاً همون چیزی که شرکتهای تکنولوژی میگن استفاده کنین، ملت دارن انجام میدن و خب، باحالیاش رو هم داره، ولی گاهی خیلی شلم شوربا میشه!

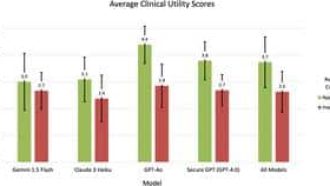

حالا بیای با هم فکر کنیم: اگه واقعاً هوش مصنوعی میتونه تو درمان و مشاوره نقش داشته باشه، مشکلی هست؟ جالب اینجاست که چند وقت پیش هم اولین آزمایش بالینی رسمی روی یه ربات درمانگر AI انجام شد (آزمایش بالینی یعنی یه آزمایش علمی که واقعاً دارن کارکرد یه چیز رو در درمان آدمها اندازهگیری میکنن). نتایجش هم خوب بوده و نشون داده شاید این روش به درمان افسردگی کمک کنه! اما بحث مهم اینجاست که تو اون آزمایش، ربات AI دقیقاً برای همین کار ساخته شده بود و حسابی روش کار شده بود. این فرق داره با اینکه یه نفر سرخود بره وسط جلسه مشاوره اطلاعات خصوصی آدم رو بریزه تو چتباتهایی مثل ChatGPT که اصلاً برای درمان ساخته نشدن.

یه نکته جالب دیگه: همه روانشناسها که نمیخوان برن راه چتباتها رو پیش بگیرن! خیلی از اونایی که خبرنگار باهاشون حرف زده گفته بودن که بیشتر به عنوان صرفهجویی در زمان ممکنه سراغ AI برن؛ مثلاً نوشتن گزارش جلسهها براشون کلی زمانبره و دوست دارن یه ابزار کمکی باشه. ولی تقریباً همهشون تاکید کردن که اصلاً روی مشاوره و نحوه برخورد با مریض نمیتونن به AI اعتماد کنن و ترجیح میدن با همکاراشون یا منابع علمی مشورت کنن. تازه کلی هم نگرانن که اطلاعات شخصی آدمها رو تو این سایتها وارد کنن که ممکنه خطرناک باشه.

خود ابزارای هوش مصنوعی، مخصوصاً اونی که برای درمان خاص مثل CBT ساخته شده (CBT یعنی “رفتاردرمانی شناختی” که یه روش خاص رواندرمانیه)، احتمالاً میتونن یه جاهایی موثر باشن. اما ChatGPT و بقیه چتباتای عمومی که برای مشاوره ساخته نشدن، واقعاً جایگزین درمان تخصصی و آدمی نمیشن.

یه نکته مهم دیگه هم بحث اخلاق و قانونیه! تا الان انجمن روانشناسی آمریکا (American Counseling Association یعنی همون سازمانی که قوانین رسمی روانشناسی رو تعیین میکنه) گفته مشاورها نباید از AI برای تشخیص بیماری یا راهکار درمانی استفاده کنن. تازه بعضی ایالتهای آمریکا مثل نوادا (Nevada) و ایلینوی (Illinois) هم قانون گذاشتن که روانشناسها حق ندارن هیچ تصمیم درمانی رو با کمک AI بگیرن. احتمالاً ایالتهای دیگه هم از این کارها کنن.

جالبه بدونی حتی سام آلتمن (Sam Altman) که مدیر OpenAI هست (OpenAI همون شرکتیه که ChatGPT رو ساخته)، گفته خیلیها از این چتبات مثل روانشناس استفاده میکنن و خودش هم این رو چیز خوبی میدونه! ولی واقعاً آیا این چیزی که شرکتهای تکنولوژی نشون میدن، همونی هست که مردم بهش احتیاج دارن؟

این رو باید بدونیم که شرکتای تکنولوژی شاید دارن مردم رو تشویق میکنن به همین نوع استفادهها چون باعث میشه مردم بیشتر وابسته محصولاتشون بشن. اما چیزی که از این ابزارا میگیریم الزاماً “درمان واقعی” نیست. رواندرمانی واقعی یعنی کسی تو رو به چالش میکشه، گاهی حرفای ناراحت کننده میزنه، و باهات کار میکنه تا خودت رو بهتر کشف کنی. چتباتها شاید فقط حرفات رو تایید کنن یا باهات همدلی کنن اما هیچ وقت جای درمان واقعی رو نمیگیرن.

در کل اگه داری پیش روانشناس میری، خیلی منطقیه که اگه درباره استفاده از AI چیزی نمیدونی، حتماً ازش بپرسی! چون اعتماد، بزرگترین پایه یه رابطه درمانیه و اگه ببینی ناخواسته اطلاعاتت رو به ابزارهای ناشناخته داده شدن، واقعاً به اون اعتماد آسیب میزنه.

منبع: +