خب بیا با هم درباره یه موضوع باحال و نسبتاً تخصصی حرف بزنیم: همکاری وایفای و فایوجی توی باند ۶ گیگاهرتز، اونم با کمک هوش مصنوعی جدیدی که اسمش LLM هست. اول بذار یه کم فضا رو توضیح بدم!

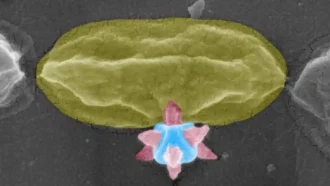

تا چند سال پیش، باند ۶ گیگاهرتز یه جورایی خالی بود اما الان حسابی شلوغ شده چون هم وایفای جدید (که بهش Wi-Fi 6E میگن) اومده سراغش، هم نسخه بیسیم فایوجی به اسم NR-U! یعنی کلی دستگاه دارن اونجا تلاش میکنن بهترین سرعت رو بگیرن. این دوتا باید طبق یه قاعده به اسم listen-before-talk (یا همون LBT یعنی “قبل حرف زدن، گوش بده”) با هم زندگی کنن: یعنی هرکی قراره چیزی بفرسته باید اول چک کنه کانال آزاده یا نه.

حالا سوال اصلی اینه که چطوری منابع رو بین این دو تکنولوژی تقسیم کنیم که هم سرعت خوب بمونه، هم مصرف انرژی زیاد نشه، هم هر دستگاه طبق اون قراردادی که داره سرویسها رو به موقع بگیره (اینو بهش SLA میگن، یعنی توافق سطح سرویس، مثلاً اینکه یه ویدیوی کیفیت بالا بدون قطع و مکث بهت برسه).

اینجا یه ایده جالب مطرح شده: استفاده از یه نوع هوش مصنوعی به اسم LLM یا Large Language Model — مثلاً همونهایی که میتونن متن بنویسن یا خلاصه کنن و کلاً وقتی حرف از Generative AI میزنن منظورشون این مدلهاس. این مقاله داره نشون میده که اگه LLMها رو بذارن وسطِ بخش تصمیمگیری تخصیص منابع وایفای و NR-U، کلی میشه بهینهتر عمل کرد.

گرفتن این تصمیمها خودش دردسره چون باید چند تا فاکتور همزمان در نظر گرفته بشه: سرعت دیتای بچهها، مصرف انرژی گجتها، تاخیر، باتری کاربرا و حتی اینکه هر کاربر چقدر کارش مهمه. اینجا تیم سازنده سیستمی ساختن که اسمش agentic orchestrator هست — یعنی یه جوری هوشمند که خودش میتونه استراتژی بچینه و کارها رو بچرخونه.

داستان جالبتر وقتی میشه که این سیستم، مدیریت (یا policy) رو از اجرا (یا execution) جدا میکنه؛ یعنی اول میاد دادههای وضعیت لحظهای هر کانال (مثلاً چقدر شلوغه یا چند تا تلاش ناموفق برای ارسال داشتن)، وضعیت کلی هر کاربر (کیفیت کانکشن، تاخیر، میزان بکلاگ یا صف، باتری، الویت، و اینکه الان روی چه وضعیتی از صرفهجویی برق هست) رو خلاصه میکنه و این دادهها رو میفرسته سراغ LLM.

اینجا LLM میاد چند تا پیشنهاد عملی واضح میده؛ مثلاً یه عدد به اسم ضریب انصاف یا همان alpha خودمون میده (که تعیینکننده میزان عدالته و مثلاً alpha=0 خیلی خودخواهانه است و هرکی زورش بیشتر باشه جلوتره، اما alpha بزرگتر یعنی بجای کل سرعت، بیشتر برابری رو حفظ کنن)، یا سهم زمانی که وایفای و NR-U هرکدوم مجازن از کانال استفاده کنن (همون duty-cycle cap)، یا وزندهی کلاسهای مختلف کاربرها.

بعد یه اپتیمایزر (یعنی بهینهساز) خیلی شستهرفته و قطعی میاد چک میکنه که همه چیز بیخطر و منطقی باشه — اگر پیشنهاد LLM عجیب بود (مثلاً خطری داشت یا با قوانین سازگار نبود)، خودش میندازه رو یه حالت پیشفرضِ تستشده. همیشه هم باید حواسشون به بحث LBT و مصرف انرژی باشه که همه چی منصفانه و به درد بخور بمونه.

توی آزمایشای این بچهها، اومدن توی یه شبیهساز ۶ گیگاهرتز با دو تا کانال ۱۶۰ مگاهرتزی و کاربران قاطی وایفای و NR-U، این سیستم رو تست کردن. نتیجه عجیب بوده: سیاستهایی که LLM بهشون کمک کرده، تونسته مصرف انرژی رو خیلی بهتر کنه بدون اینکه سرعت کلی خیلی افت کنه. مثلاً یک نمونه از این LLMها میتونسته مصرف انرژی رو ۳۵.۳٪ بیاره پایین – البته با یه مقدار کم کاهش سرعت. یه مدل دیگه حتی تونسته هم مصرف انرژی رو بهتر کنه هم سرعت کلی رو ۳.۵٪ بالاتر ببره و نسبت بیت به ژول (یعنی مقدار داده به ازای هر انرژی مصرفی) رو ۱۲.۲٪ قویتر کنه نسبت به حالت مرسوم.

جالب اینجاست که تیم تحقیق کدها و حتی لاگهای هر بازه زمانی و ابزارهای رسم نمودارها رو رایگان گذاشتن تا هر کی خواست نتایجشون رو تست یا شبیهسازی کنه. این نشون میده میشه با شفافیت و سیاستگذاری درست، کمک هوش مصنوعی رو توی تکنولوژیهای حیاتی مثل وایرلس و موبایل، بدون خطر و با سود زیاد استفاده کرد.

خلاصه ماجرا: یه LLM دیگه فقط برای صحبت باهات نیست — بعضی وقتا میتونه هوشمندی رو بیاره وسط مسابقه سنگین وایفای و فایوجی، اونم بدون اینکه کسی ضرر کنه یا انرژی هدر بره!

منبع: +