خب بیا یه موضوع جالب رو با هم بررسی کنیم: فرض کن مریض شدی و به جای اینکه بری دکتر واقعی، یه دکتر آنلاین که با Generative AI کار میکنه (یعنی هوش مصنوعیای که خودش میتونه جواب و مشاوره بده) بهت مشاوره میده. حالا اگه همین دکتر هوش مصنوعی اشتباه کنه، تو بعدش میتونی دوباره بهش اعتماد کنی یا نه؟

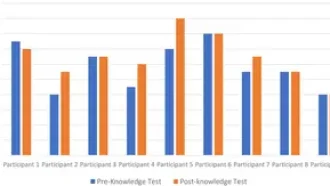

دانشمندا اومدن روی همین سؤال تحقیق کردن و بررسی کردن که چه جوری مردم دوباره حاضر میشن به این دکترهای هوش مصنوعی اعتماد کنن. خلاصه تحقیقشون این بوده: ۵۱۲ نفر رو آوردن و براشون سناریوهای مختلف رو اجرا کردن. چند تا فاکتور مهم رو بررسی کردن:

۱. Attribution Style (شیوه نسبتدادن اشتباه): یعنی دکتر هوش مصنوعی تقصیر رو میندازه گردن خودش (internal attribution = مسئولیتپذیری) یا میگه تقصیر عوامل بیرونی بوده (external attribution = گردن دیگران انداختن یا شرایط)؟

۲. Social Support (حمایت اجتماعی): این دکتر بهت فقط یه سری اطلاعات خشک میده (informational support)، یا با همدلی و احساسات باهات صحبت میکنه (emotional support)؟

۳. Anthropomorphism (انساننمایی): یعنی دکتر طوری طراحی شده که شبیه آدم حرف بزنه و رفتار کنه، یا نه، کاملاً ماشینی و خشک باشه.

نتیجهها خیلی جالب بوده! اول از همه اینو فهمیدن کسایی که دکتر هوش مصنوعی مسئولیت اشتباهش رو قبول میکنه (internal attribution)، یا با احساساتشون صحبت میکنه، یا شبیه آدمها رفتار میکنه (anthropomorphism)، راحتتر دوباره بهش اعتماد میکنن.

یه نکته جذابتر اینکه این انساننمایی (یعنی دکتر هوش مصنوعی دوستداشتنیتر و شبیه آدم حرف بزنه)، باعث میشه اون روش عذرخواهی و نوع حمایتش بیشتر اثر بذاره. یعنی وقتی دکتر هوش مصنوعی انساننما هست، رفتارهاش تو جلب اعتماد دوباره خیلی قویتر میشه.

حالا یه نتیجه ظریفتر هم گرفتن: وقتی دکتر هوش مصنوعی خودش مسئولیت اشتباه رو میپذیره (internal attribution)، اگه اطلاعات علمی و درست به مردم بده (informational support)، مردم بیشتر بهش اعتماد میکنن. ولی اگه تقصیر رو بذاره گردن شرایط یا عوامل بیرونی (external attribution)، اون موقع گفتن چیزهای احساسی و همدلی کردن (emotional support) بهتر جواب میده!

یه چیزم فهمیدن که مردم وقتی بعد از اشتباه، حس کنن اعتمادشون بازسازی شده، خیلی راحتتر دوباره از این دکترهای هوش مصنوعی استفاده میکنن. یعنی اگه یه دکتر آنلاین بلد باشه چطور دل کاربراش رو به دست بیاره، میتونه حتی بعد از خرابکاری هم آدمها رو نگه داره.

ته قصه اینکه: این یافتهها برای طراحی و ساخت دکترهای هوش مصنوعی آینده کلی کاربرد دارن. سازندهها میتونن از این روشها استفاده کنن تا دکترهای آنلاین مهربونتر، همدلیکنندهتر و البته قابلاعتمادتر درست کنن. اینجوری مشاورههای آنلاین سلامتی هم مقاومتر و مطمئنتر میشن! پس اگه دفعه بعد یه دکتر هوش مصنوعی اشتباه کرد، بهتره ببینی چطور عذرخواهی میکنه و چقدر سعی میکنه دل تو رو دوباره به دست بیاره 😉

منبع: +