خب بچهها، بیاید یه موضوع خیلی باحال رو با هم بررسی کنیم! حتماً دیدین که خیلی وقتا معمارها یا حتی خودمون وقتی میخوایم نقشه یه ساختمون یا اتاق رو بکشیم، اولین کاری که میکنیم اینه که روی کاغذ یه طرح دستساز میزنیم؛ همون اسکچ (یعنی نقاشی ساده و سریع با دست آزاد). حالا فرض کنین میشه همین اسکچ رو خیلی راحت تبدیل به یه مدل سهبعدی شیک و حرفهای کرد! اینو بهش میگن BIM یا همون Building Information Modeling که یعنی “مدلسازی اطلاعات ساختمون” – خلاصه روشی برای ساخت مدل سهبعدی با کلی جزئیات از ساختمون.

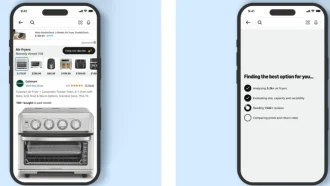

حالا محققها یه روش جدید پیدا کردن که واقعاً جذابه. میان با کمک هوش مصنوعی و البته خود آدم، اسکچ شما رو میگیرن و تبدیلش میکنن به مدل سهبعدی که هرکسی میتونه ازش استفاده کنه؛ حتی اگه هیچ سررشتهای از کار با نرمافزارای تخصصی معماری نداره!

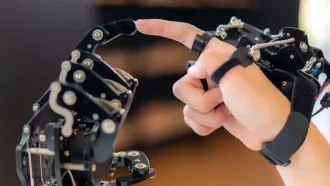

این کارو با چی انجام میدن؟ با یه سیستم به اسم Multi-Agent Human-AI Collaborative Pipeline؛ بزارین راحتتر توضیح بدم: “Multi-Agent” یعنی چندتا عامل (در اصل رباتهای نرمافزاری یا مامور مجازی) که هر کدوم ماموریت خاص خودشون رو دارن و با هم همکاری میکنن. “Human-AI Collaborative” هم یعنی خود ما آدمها و هوش مصنوعی با هم تو این فرآیند همکاری داریم. خلاصهش یعنی با یه تیم آدم و هوش مصنوعی طرفیم که هرکدوم یه گوشه کار رو میگیرن!

یکی از چیزای مهمی که تو این پروژه استفاده شده، یه تکنولوژی جدیده به اسم Multimodal Large Language Models یا همون MLLMs. یعنی چی؟ یعنی مدلهای هوش مصنوعی خیلی پیشرفته که میتونن با متن، تصویر، صدا و … همزمان کار کنن (مثلاً هم عکس رو بفهمن، هم توضیحش رو بخونن و بفهمن!).

این مدل اول میاد عکس نقاشی شما رو میبینه و با دقت کلیاتش—دیوارا، در و پنجرهها—رو درمیاره و همه رو به صورت یه فایل JSON درمیاره (فایل JSON یعنی یه جور فایل متنی که اطلاعات جوری توش ذخیره میشن که هم آدم میتونه بفهمه چی نوشته، هم کامپیوتر میتونه راحت بخونه). بعد این فایل رو به برنامههایی میدن که خودشون ازش کد مخصوص مدلسازی ساختمونی درمیارن. در واقع شما از یه نقاشی ساده میرسین به مدل سهبعدی کامل فقط با کمک هوش مصنوعی و یه کم بازخوردی که خودتون به سیستم میدید!

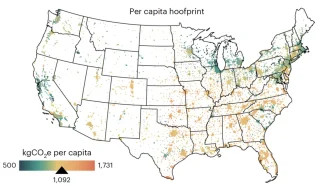

توی این پروژه، آزمایش رو با ده تا نقشه مختلف انجام دادن تا ببینن چه جوری کار میکنه. از همون اول، درها و پنجرهها رو خیلی دقیق پیدا میکرد (یعنی همون گذرگاههایی که تو دیوار باز میشه)؛ درصد موفقیت کشفشون خیلی بالا بود. پیدا کردن دیوارها یه کم سختتر بود، ولی از همون اول حدود ۸۳ درصد دقیق بودن و با هر بار بازخورد گرفتن از کاربر، این عدد دائماً بهتر میشد و تقریباً به حالت ایدهآل میرسید.

توضیح کوچیک: Precision و Recall و F1 چی هستن؟ خب اینها معیارهایی هستن که توی کارای هوش مصنوعی استفاده میشن تا بفهمن یه مدل چقدر کارش رو درست انجام داده! مثلاً Precision یعنی چه درصد چیزایی که مدل پیدا کرده، واقعاً درست بودن، Recall یعنی چند درصد چیزایی که باید پیدا میکرد، پیدا کرده و F1 یعنی میانگین این دو تا. همه اینها بیشتر از ۰/۸۳ بودن که خیلی خوبه.

همچنین، میزان خطاهای هندسی (مثل RMSE و MAE، که یعنی مدل چقدر از واقعیت فاصله داشت) هم تو هر بار اصلاح با بازخورد کاربر کم و کمتر شد و آخرا تقریباً صفر شد!

خلاصه حرف این مقاله اینه که با همین ابزار و همکاری بین آدم و هوش مصنوعی، حتی اگه یه نقاشی ساده با دست هم بکشین، میتونین تبدیلش کنین به یه مدل سهبعدی حرفهای ساختمون؛ لازم هم نیست حتماً مهندس یا کاربلد باشین! آینده معماری رسماً اینجوری داره راحت و دم دست میشه. خیلی کول، نه؟

منبع: +