تا حالا فکر کردی همه چی که تو اینترنت میذاری، حتی عکس پاسپورت، کارت ملی، یا حتی رزومه و آدرس خونت، ممکنه یه جایی تو دل هوش مصنوعیها ذخیره شده باشه و خودت خبر نداشته باشی؟ خب، یه تحقیق جدید نشون داده تو یکی از بزرگترین دیتاستهای آموزش تصویر برای هوش مصنوعی به اسم DataComp CommonPool، کلی اطلاعات شخصی آدما پیدا شده. دیتاست یا “Data set” یعنی همون مجموعه بزرگی از دادهها (مثلاً عکس یا متن) که باهاش مدلهای هوش مصنوعی رو آموزش میدن.

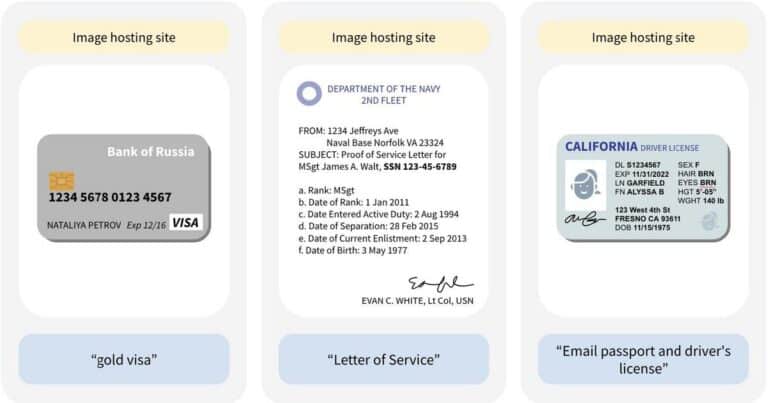

این محققها تنها ۰.۱ درصد این دیتاست رو بررسی کردن (یعنی واقعاً مقدار خیلی کمی!) ولی هزاران عکس واضح از چهرهها و اسناد هویتی مثل کارت اعتباری، گواهینامه، پاسپورت، شناسنامه و… پیدا کردن. حتی حدود ۸۰۰ رزومه و مدارک شغلی معتبر هم دیدن که مربوط به افراد واقعی بود. یعنی احتمالاً تو کل دیتاست، صدها میلیون تصویر اطلاعات شخصی هست که شاید حتی خود دارندگانش خبر ندارن!

مثلاً رزومههاشون اطلاعات حساسی مثل وضعیت سلامتی، معلولیت، نتایج استعلام سوءسابقه، تاریخ و مکان تولد فرزندان، نژاد، آدرس خونه و شماره تماس خودشون یا معرفهاشون رو لو داده بودن. خلاصه خیلی چیزها که حتی آدم فکرش رو هم نمیکنه امکان داره اینجوری سِر (scrape) بشه.

خود دیتاست DataComp CommonPool که سال ۲۰۲۳ منتشر شد، با ۱۲.۸ میلیارد دادهی تصویر-متن، یکی از بزرگترین دیتاستها برای آموزش مدلهای تصویرساز هوش مصنوعی بوده. مدلهای Generative AI یعنی مدلهایی که میتونن خودشون چیز جدید بسازن، مثلاً یه تصویر بر اساس توضیحات شما تولید کنن.

بخشی از داستان اینجاست که CommonPool بر پایهای از اطلاعات ساخته شده که توسط یه سازمان غیرانتفاعی به اسم Common Crawl از اینترنت بین سالهای ۲۰۱۴ تا ۲۰۲۲ جمعآوری شده. این کار با روش Web Scraping بوده که یعنی یه سری ربات وب رو شخم میزنن و دیتای همه چی رو جمع میکنن. جالبه بدونی دیتاست LAION-5B که برای مدلهای معروفی مثل Stable Diffusion و Midjourney هم استفاده شده، دقیقاً از همین منبع جمع شده. پس احتمالاً اطلاعات شخصی تو اونها هم هست و این داستان فقط مال CommonPool نیست.

یه نکته مهم اینه که CommonPool تا حالا بیش از ۲ میلیون بار دانلود شده! یعنی احتمال داره کلی مدل دیگه هم که ما نمیشناسیم، با همین دادهها آموزش دیده باشن و این خطر رو تکثیر میکنن.

حالا شاید فکر کنی که حتماً یه سری فیلتر یا محافظت کار گذاشتن تا جلوی لو رفتن این اطلاعات رو بگیرن. ولی در واقع فیلترها خیلی ناقص بودن. مثلاً یه الگوریتم اتوماتیک چهرهها رو تار (blur) میکرد، اما تو نمونه کوچیک محققها، بیش از ۸۰۰ چهره رو پیدا کردن که فیلتر از قلم انداخته بود. خودشون تخمین زدن این الگوریتم کلاً تو دیتاست بالغ بر ۱۰۲ میلیون چهره رو نادیده گرفته. تازه این فقط چهره بود! به اطلاعات متنی مثل ایمیل یا شماره ملی یا captionها (که همون متنهای زیرعکس هستن) اصلاً کاری نداشتن و خیلی راحت اینها هم باقی مونده.

حتی اون فیلتری که چهرهها رو تار میکنه هم قابل برداشته، یعنی کاربرها میتونن خودشون حذفش کنن. اسمهایی مثل Hugging Face که یه پلتفرم توزیع دیتاست هست، ابزارهایی برای جستجو و حذف اطلاعات شخصی گذاشته، اما واقعاً چند نفر میدونن باید دنبال کدوم اطلاعاتشون بگردن؟ و آیا اصلاً پیدا میکنن؟

مسئله اینجاست که حتی اگه بری و اطلاعاتت رو حذف کنی، مدلِ هوش مصنوعیای که قبلاً با اون آموزش دیده، اطلاعات تو رو به شکلی یاد گرفته و دیگه نمیشه اثرش رو کامل پاک کرد. یه جورایی دیگه کار از کار گذشته. تو قوانین مثل GDPR اروپا یا CCPA کالیفرنیا اومده که افراد حق حذف اطلاعات شخصیشون رو دارن، اما قانون هنوز شفاف نیست که ریتِرین نشدن مدلهای آموزشدیده شده هم شاملشه یا نه.

یه چالش بزرگتر هم اینه که خیلی از این قوانین فقط برای شرکتهای بزرگ یا با خصوصیت مشخص نوشته شدن و محققهایی که دیتاست میسازن کلاً خارج از این دایره قرار میگیرن. تازه کلی استثنا هم وجود داره. مثلاً طبق قانون وقتی اطلاعات «عمومی» حساب میشن، دیگه محدودیتی براشون نمیذارن. محققها دقیقاً با همین استدلال میگن هر چی تو اینترنت هست، یعنی عمومی و آزاد برای استفاده. اما ببین چقدر چیزهای شخصی و خصوصی توی این دسته حساب میشن که خودمون هم فکر نمیکردیم: رزومه، عکس بچگی، کارت اعتباری، داستان زندگی تو وبلاگهای قدیمی، و کلی چیز خارج از میل خودمون.

باحاله بدونی خیلی از عکسها و مدارک حتی مربوط به کودکان بودن، مثلاً شناسنامه، پاسپورت یا وضعیت سلامتی، که برای یه منظور محدود (مثلاً ثبتنام تو مدرسه یا معرفی تو وبلاگ کوچیک خانوادگی) آپلود شده بوده. ولی الان رفتن تو دیتاستی که برای آموزش کلی مدل تصویرساز AI استفاده میشه. خلاصه هر چی یه بار تو اینترنت بذاری، دیگه معلوم نیست کجا و چظوری دوباره سر دربیاره!

بحث اصلی این محققها اینه که زمانشه جامعه هوش مصنوعی استفاده خیلی راحت از دادههای وب رو مرور کنه و داستان رضایت (Consent) رو جدی بگیره. چون خیلی از دادهها قبل از فراگیر شدن AI آپلود شده و هیچکسی فکرش رو نمیکرد برای آموزش مدلهای هوش مصنوعی جمع بشه. تازه به دلیل اینکه رباتهای Scaper هی از هم کپی میکنن و اطلاعات رو دوباره نشر میدن، حتی اگه یه جا اطلاعاتت رو حذف کنی، ممکنه تو جاهای دیگه هنوز باشه.

در انتها هم یکی از محققها میگه: «اگه داری وب رو scrape میکنی، حتماً توی دیتاهات اطلاعات خصوصی جمع کردی—حتی اگه تلاش کنی فیلتر کنی، باز با این حجم عظیم نمیتونی همه رو بپوشونی.»

پس دفعه بعد که داشتی یه مدرک یا عکسی رو تو اینترنت آپلود میکردی، یادت باشه امکان داره یه مدل هوش مصنوعی اون رو بعدها تو دیتاست آموزش خودش داشته باشه، مگر اینکه سیاستهای جدیتر و قوانین سختتر برای محافظت از اطلاعات شخصی تصویب بشه. این تحقیق صدای خطر رو بلند کرده تا بالاخره تغییراتی در قوانین و فرهنگ کار با داده عمومی تو AI ایجاد بشه.

منبع: +