خب رفیق، حتماً اسم ترنسفورمرها (transformer) رو شنیدی، همون مدلی که الان همه جا تو دنیای هوش مصنوعی صداش دراومده و چتباتها و چیزهای باحالی مثل ChatGPT و بقیه باهاش کار میکنن. این مدل سال ۲۰۱۷ معرفی شد و واقعاً یه انقلاب تو پردازش زبان طبیعی (NLP) راه انداخت. یعنی دقیقا باعث شد ماشینها بتونن بهتر متوجه بشن چی داریم میگیم و جواب درستودرمان بدن.

حالا اصل قضیه اینه که این ترنسفورمرها یه جور معماری خاص دارن و تمام پایهشون روی یه مفهوم به اسم attention بنا شده. Attention یعنی «توجه داشتن»؛ یه سیستمه که باعث میشه مدل بتونه تصمیم بگیره به کدوم قسمتهای ورودی بیشتر دقت کنه. یعنی مثلاً وسط یه جمله، مدل خودش انتخاب میکنه چه کلمههایی مهمترن و باید روشون زوم کنه. همین باعث میشه مدل خیلی بهتر و عمیقتر بفهمه ما چی میخوایم بگیم یا اصلاً چه جوابی بده.

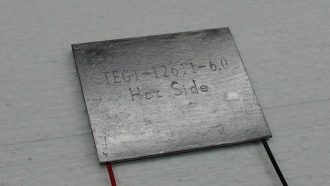

تا اینجای کار همه خوبه، ولی یه مشکلی هست: هرچی مدلای هوش مصنوعی بزرگتر شدن، دانشمندا حس کردن هنوز دقیقاً نمیدونیم این ترنسفورمرها چجوری واقعاً کار میکنن – مخصوصاً از نظر فیزیکی! یعنی میدانیم که برنامهنویسی چیه و ریاضیش چطوریه، ولی اینکه واقعاً تو دل چیپها (همون تراشه کامپیوترها) چی میگذره و آیا میتونیم براش یه مدل فیزیکی واقعی دربیاریم یا نه، هنوز یه عالمه سواله.

توی این مقاله، دانشمندا اومدن یه نگاه خیلی متفاوت انداختن: گفتن بیاید مدلهای فیزیکی برای ترنسفورمرها درست کنیم، اونم توی یه فضای عجیبوغریب به اسم فضای فوک (Fock Space) بالای فضای هیلتبرت (Hilbert Space) توکنها. حالا بذار یه کم توضیح بدم:

- فضای فوک (Fock Space): یه مفهوم توی فیزیک کوانتومه که برای توصیف سیستمهایی که تعداد ذراتشون متغیره استفاده میشه. فرض کن یه جعبه داری که میتونه هر چندتا توپ توش بذاری – این فضا همون کار رو برای ذرهها یا تو اینجا همون توکنها انجام میده.

- فضای هیلتبرت (Hilbert Space): یه جور فضای ریاضیاتی پیشرفتهست که فیزیکدونا و ریاضیدونا استفاده میکنن تا رفتار سیستمهای پیچیده (حتی کوانتومی!) رو توصیف کنن.

- توکن: تو هوش مصنوعی، هر قطعه کوچیک از متن (مثلاً یه کلمه یا حتی یه تیکه از یه کلمه) رو بهش میگن توکن.

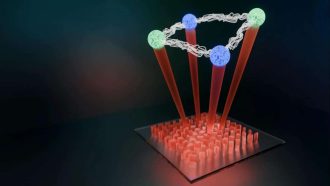

خب، دانشمندا چی میگن؟ میگن اگه به این ماجرا فیزیکی نگاه کنیم، میتونیم مدلهای فیزیکی واقعی درست کنیم که رفتاری شبیه ترنسفورمرها نشون میدن. اونم طوری که میشه این مدلها رو به صورت ‘Open Quantum Systems’ هم درنظر گرفت. (Open Quantum Systems یعنی سیستمهای کوانتومیای که آزادانه میتونن با محیط تعامل داشته باشن)

در واقع مقاله میخواد نشون بده میشه مغز متفکر این مدلهای زبانی بزرگ رو با اصول فیزیک کوانتوم هم ساخت و توضیح داد. اینجوری هم میفهمیم تو تراشهها دقیقاً چه خبره و هم شاید مسیرهای جدیدی برای ساخت مدلهای بهتر باز بشه. خلاصه میخوان یه پلی بزنن بین دنیای ریاضی و فیزیک کوانتوم و همین دنیای گنگ نرمافزاری هوش مصنوعی!

اگه بخوای راحتتر بگم: این تیم میخواد نشون بده معماری ترنسفورمر فقط یه الگوریتم تو نرمافزار نیست؛ میشه براش مدل فیزیکی پیدا کرد. شاید یه روز بتونیم تو آینده حتی سختافزارهایی بسازیم که مخصوص اجرای این رفتارها طراحی شدن و همهچی سریعتر و کاربردیتر بشه.

در کل، دنیای هوش مصنوعی نه تنها از نظر نرمافزاری بلکه از طرف فیزیکی هم داره کلی پیشرفت میکنه. احتمالاً باید منتظر مدلهای زبانی بشیم که در حد یه سیستم فیزیکیِ واقعی کار میکنن – با مغز پیچیدهتر و فهم عمیقتر!

منبع: +