همیشه بهمون گفته بودن قراره ماشینها و رباتها کارهای آدمها رو انجام بدن؛ مثلاً ماشینهایی که خودشون رانندگی میکنن یا رباتهایی که خونه رو تمیز میکنن. ولی چیزی که واقعاً دیدیم این بود که هوش مصنوعی (همون AI که خلاصه Artificial Intelligence هست) اومده و توی کارهای ذهنی مثل شطرنجبازی، تحلیل حجم عظیمی متن یا حتی سرودن شعر از خیلی آدما قویتر شده! خیلی جالبه که کارهای فیزیکی برای رباتها خیلی سخته، ولی الگوریتمها دارن توی خلاقیت مغزمون رو به چالش میکشن.

چیزی که مدتها دانشمندها رو گیج کرده بود، همین خلاقیت عجیب الگوریتمها بود. مخصوصاً تو نسل جدید الگوریتمها به اسم “مدلهای دیفیوژن” (Diffusion Models) که پایه ابزارهایی مثل DALL·E، Imagen یا Stable Diffusion هستن. این مدلها در اصل فقط باید کپی تصاویر آموزشدیدشون رو بسازن، ولی توی عمل، میان یه چیز جدید خلق میکنن؛ مثلاً چنتا چیز رو قاطی میکنن و تصویر تازهای درست میکنن که معنیدار هم هست! این قضیه خیلی غیرمنتظرهس، چون طبق تئوری باید فقط حفظ کنن و مثل ماشین کپی خروجی بدن، ولی تو عمل یه نوع خلاقیت عجیب از خودشون نشون میدن.

حالا ببین اصلاً این مدلهای دیفیوژن چطور کار میکنن: اول میان تصویر رو میگیرن و تبدیلش میکنن به نویز دیجیتالی (noise)، یعنی یه عالمه نقطه رنگی بیمعنی – مثل وقتی که یه نقاشی رو بندازی تو دستگاه خردکن تا فقط پودر شه! بعد همین تکهپارهها رو با پروسهای به اسم “denoising” دوباره سعی میکنن بسازن. سؤال اینه: چطور وقتی فقط دارن دوباره این تکهها رو کنار هم میذارن، خروجی جدید و خلاقانه درمیاد؟

این وسط دوتا فیزیکدان اومدن یه ادعای باحال مطرح کردن: میگن همین نقصهای تکنیکی توی پروسه denoising باعث خلاقیت مدلهای دیفیوژن شده! در واقع این خلاقیت یه نتیجه اجتنابناپذیر از معماری مدلهاست، نه یه جادوی عجیب و غریب. توی مقالهای که قراره سال ۲۰۲۵ توی کنفرانس بینالمللی یادگیری ماشین (Machine Learning Conference) ارائه بدن، نشون دادن این خلاقیت اتفاقی نیست و کاملاً قابل پیشبینیه.

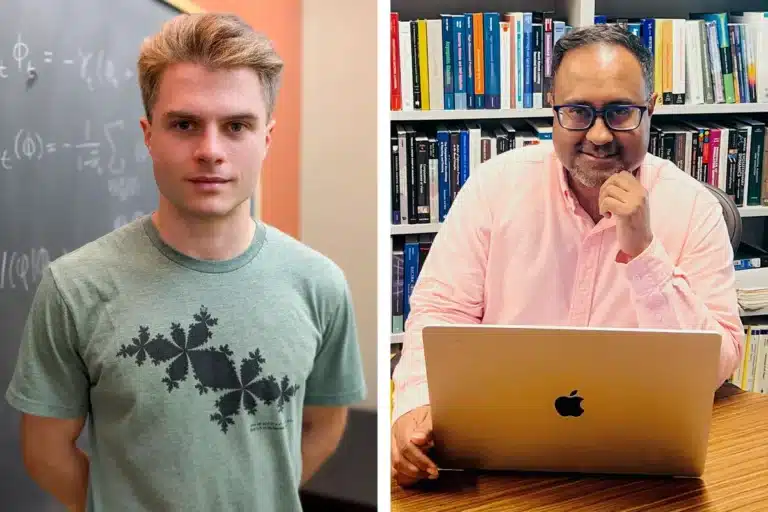

یکی از نویسندههای اصلی این مقاله، میسون کمپ (Mason Kamb)، دانشجوی دکترای فیزیک کاربردی از دانشگاه استنفورد، سالهاست به یه مفهوم به اسم “مورفوژنز” (Morphogenesis) علاقه داره. مورفوژنز یعنی همون فرآیندهایی که باعث میشن سلولهای موجودات زنده خودبهخود سازماندهی بشن و مثلاً یه دست یا یه اندام خاص بسازن. مدل مشهورش الگوی تورینگ (Turing pattern) هست، که اسمش از آلن تورینگ گرفته شده؛ ایشون ریاضیدان معروف قرن بیستم بوده. ساز و کارش به این شکله که هر سلول فقط با همسایههاش در ارتباطه و هیچ مدیری بالا سرشون نیست. سیستم “از پایین به بالا” مثل اینه که همه خودشون تصمیم میگیرن.

وقتی اولین تصاویر هوش مصنوعی رو تو اینترنت دیدیم، خیلیاشون شبیه نقاشیهای سورئال بودن؛ مثلاً آدمایی با شیش تا انگشت! این دقیقاً همون چیزی بود که کمپ رو یاد مورفوژنز انداخت – یعنی خودش گفت: انگار یه اختلال سیستمی از نوع پایین به بالا داریم که نتیجهش این شده!

حالا بذار سادهتر بگم چرا مدلهای دیفیوژن اینطوری شدن: AI برای ساختن تصویر دوتا ترفند فنی میزنه. اولیش لوکال بودن (locality) یا محلی بودنِ تمرکزه؛ یعنی فقط روی یه قسمت کوچیک (یا “patch” پیکسلها) کار میکنه. دومیشقدرت تغییرناپذیری ترجمهای (translational equivariance) هست؛ یعنی اگه ورودی رو دو تا پیکسل اینور اونور کنی، مدل هم خودش رو هماهنگ میکنه تا ساختار کلی خراب نشه. این قابلیت باعث میشه تصویر واقعیتر و منسجمتر باشه.

اینجوری هر تیکه تصویر رو جدا به صورت لوکال میسازه و خیلی اهمیت نمیده که این تیکه آخر کجای تصویر میشینه! بعدش با معادلات ریاضی به اسم “score function” یا همون الگوریتم امتیازدهی (یادآور Turing pattern دیجیتاله)، همه تیکهها رو به هم میچسبونه.

تا همین چند وقت پیش، دانشمندها فکر میکردن این محدودیتها فقط یه نقطه ضعفه و باعث میشه مدلها خروجیهای خندهدار (مثل دست ششانگشتی) بسازن، نه اینکه سرچشمه خلاقیت بشن! ولی حالا یه انقلاب فکری شکل گرفته.

کمپ و استادش سوریا گنگولی (Surya Ganguli) یه سیستم طراحی کردن به اسم ELS machine (equivariant local score) که فقط با همین دو خاصیت لوکال بودن و تغییرناپذیری میتونه پیشبینی کنه تصویر تصحیحشده (denoised) چی درمیاد. حتی بدون اینکه مدل از قبل آموزش دیده باشه! اومدن تصویرهای گوناگون رو تبدیل به نویز کردن، بعد با این دستگاه ELS و با مدلهای معروف مثل ResNet و UNet مقایسه کردن. نتیجهش خیلی عجیب بود: این سیستم تا ۹۰٪ تونسته خروجی مدلهای دیفیوژن رو اینهمانی پیشبینی کنه! این دقت، توی ماشینلرنینگ واقعاً نادره.

پس چی شد؟ همون ویژگیهایی که تا دیروز فکر میکردیم نقطه ضعف مدلهای دیفیوژن هست، الان مشخص شده که خودش منشأ خلاقیته و باعث میشه مدل بدون هیچ طرح کلی از کار نهایی، فقط با تمرکز روی تیکهتیکهها، تصاویر تازه خلق کنه. حتی همین پدیده دستهای چندانگشتی ناشی از همین مسئلهس: مدلها فقط به یه پچ از پیکسلها نگاه میکنن و براشون مهم نیست بقیه تصویر چیه.

البته این تحقیق تازه اول ماجراست. چون مثلاً مدلهای زبانی بزرگ یا هوش مصنوعیهایی که متن تولید میکنن، مثل همین چتباتها، از این ترفندها استفاده نمیکنن ولی اونام خلاقیت نشون میدن. پس بخشی از معما حل شده، ولی هنوز کل جواب زیر سر مدلهای دیفیوژن نیست.

نکته جذاب آخر اینه که این کشف حتی میتونه چیزهایی درباره ذهن انسان بهمون یاد بده! یکی از پژوهشگران دیگه به اسم بنجامین هوور گفته انسان هم دقیقاً از خاطرات، رویاها، شنیدهها و دیدههاش مثل بلوکهایی برای ساختن ایدههای جدید کمک میگیره؛ درست مثل AI که بلوکهای دادهشو میچینه. هر دو (انسان و هوش مصنوعی) دارن با اطلاعات ناقص بهترین نتیجۀ ممکن رو میسازن و بعضی وقتا یه چیز باحال و جدید از آب درمیاد – شاید اسم این همون “خلاقیت” باشه!

پ.ن: این مقاله خلاصه و دراماتیزۀ مقاله اصلی Quanta Magazine بود و به کمک سایت Live Science براتون توضیح داده شد 😉

منبع: +