راستش دیگه این روزا هر کی یه کم در مورد هوش مصنوعی (همون AI) شنیده، ولی خیلی کم پیش میاد که حرف از عدالت، تنوع و شمول یا همون Equity, Diversity, Inclusion (EDI) تو پروژههای هوش مصنوعی مخصوصاً تو حوزه سلامت و پزشکی زده بشه. حالا خود EDI یعنی چی؟

- “عدالت” اینجا یعنی همه آدما، فارغ از جنسیت، نژاد یا شرایط اجتماعیشون، دسترسی برابر و عادلانه به امکانات هوش مصنوعی داشته باشن.

- “تنوع” یعنی مجموعهای از آدمای مختلف توی این پروژهها شرکت داشته باشن؛ نه فقط یه گروه خاص.

- و “شمول” یعنی همه باید حس کنن که واقعاً وجودشون اهمیت داره و دیده میشن، تو تصمیمگیریها هم مشارکت کنن.

توی یه مقاله خیلی جالب که یه تیم از پژوهشگرای باحال به رهبری تینگ وانگ و چند نفر دیگه نوشتن، اومدن و حسابی درباره همین موضوع بحث کردن. اینکه چرا و چطور باید اصول EDI رو تو تمام مراحل ساخت و استفاده از هوش مصنوعی تو سلامت رعایت کنیم.

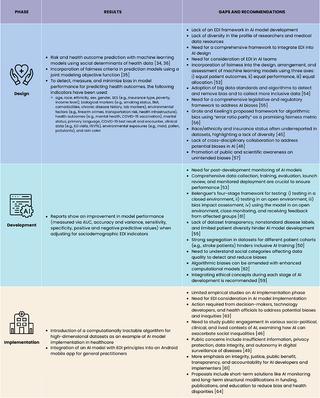

اونا چی کار کردن؟ خب، یه بررسی کلی (Scoping Review یعنی یه مدل مطالعه که خلاصه و کلی نگاه میندازه ببینه برای یه موضوع خاص چه تحقیقهایی انجام شده) انجام دادن. اومدن از کلی دیتابیس، مثل MEDLINE و Embase و Scopus و… تا انتهای آوریل ۲۰۲۲ کلی مقاله جمع کردن. فکر کن، تو جستجوشون ردی از ۱۰۶۶۴ تا تحقیق پیدا کردن! ولی دست آخر فقط ۴۲ تا مقاله رو انتخاب کردن که واقعاً محورشون ادغام (Integration) EDI تو هوش مصنوعی تو سلامت بوده.

روش کار اینجوری بوده که دوتا مرورگر مستقل (Reviewer یعنی کسی که مقالهها رو بررسی میکنه) اول خلاصه مقالهها و بعد متن کاملشون رو چک کردن و اگه اختلاف داشتن، نفر سوم رو خبر کردن تا حل کنه!

اکثر تحقیقات روی جمعیت آمریکا بوده و خیلی جالبه که نتایج قبلاً نشون داده وقتی فاکتورای جمعیتی (Socio-demographic factors مثل جنسیت یا نژاد) رو توی مدلهای هوش مصنوعی لحاظ بکنین، مدلها خروجی بهتری میدن. یعنی اگه فقط رو یه نژاد یا جنسیت تمرکز کنین، خروجی مدل ممکنه برای آدمای دیگه غلط یا مغرضانه (Bias یعنی طرفداری، یه گوشهای رو گرفتن) باشه.

با اینکه کلی چارچوب (Framework یعنی چهارچوب و دستورالعمل برای یه کاری) مختلف برای افزودن EDI داریم، فعلاً هیچ روش همهجانبه و کاملی وجود نداره که بشه همهجا اصول EDI رو سیستماتیک وارد توسعه مدلهای هوش مصنوعی کرد. یعنی چی؟ یعنی مثلاً شرکتها و تیمها یه چارچوب اولیه دارن ولی هیچ کسی کل پروسه رو کامل و حرفهای بر اساس EDI پیش نمیبره.

تازه اینم بگم که تو فاز اجرای هوش مصنوعی هم بحث EDI خیلی جدی گرفته نشده. خیلی وقتا نمایندههای واقعی گروههای مختلف اجتماعی تو تیمهای هوش مصنوعی اصلاً حضور ندارن یا نظراتشون شنیده نمیشه. انگار کلاً فراموششون کردن!

خلاصه، این مطالعه نشون داد هم تلاشای خوبی برای ادغام EDI تو طراحی و توسعه و اجرای هوش مصنوعی تو سلامت انجام شده، ولی هنوز راه نرفته زیاد باقی مونده. باید یه چارچوب جامعتر طراحی بشه تا از اول تا آخر پروژه هوش مصنوعی، بحث عدالت، تنوع و شمول توش باشه.

پیشنهادشون واسه پژوهشهای آینده اینه که:

- باید استراتژیهایی پیدا کرد که این طرفداریهای الگوریتمی (Algorithmic bias یعنی وقتی الگوریتم فقط یه دسته رو ترجیح میده یا یه عده رو نادیده میگیره) رو کم کنه.

- تاثیر بلندمدت ادغام EDI بررسی بشه (یعنی فقط الان نه، بلکه ببینیم تو بلند مدت چی تغییر میکنه).

- و اینکه ببینیم اگه سیاستگذاریها (Policy implications یعنی اثر روی قانون و مقررات) بیشتر سراغ EDI تو هوش مصنوعی برن، چقدر پروژهها منصفانهتر، مسئولانهتر و به درد همه میخورن یا نه.

البته این مطالعه هم مثل همه کارا یه سری محدودیت داشت: مثلاً فقط مقالههایی رو نگاه کردن که به زبان خاصی بودن یا چاپ شده بودن و این خودش ممکنه بعضی نتایج رو نادیده بگیره (همون Language & Publication Bias). ولی در کل خیلی سراغ منابع مختلف رفتن و روششون هم حسابی دقیق بوده.

پس خلاصه بخوای بدونی: اگه میخوایم هوش مصنوعی تو سلامت واقعاً منصفانه و به درد همه باشه، باید از همین اول تا آخر سر بحث EDI خیلی جدی باشیم. فقط ساخت یه ابزار خفن مهم نیست؛ باید دقت کنیم واسه همه درست کار کنه، همه تو توسعهش حضور داشته باشن و کسی از قلم نیفته!

منبع: +