حتما میدونی که امروزه برای پیدا کردن خطا یا همون ناهنجاری (anomaly) تو دیتای شرکتها، حسابی از هوش مصنوعی و یادگیری عمیق استفاده میکنن. اما همیشه دوتا مشکل بزرگ بوده: یکی اینکه باید همه دادهها رو جمع کنن وسط، که خب خطر لو رفتن اطلاعات هست. دوم اینکه وقتی تعداد کاربرا و دادههای پراکنده زیاد میشه یا هرکسی دیتای متفاوت داره، این مدلها جواب نمیدن یا کند عمل میکنن. تازه بیشتر راهحلها اصلا به فکر فناوریهای جدیدتر مثل محاسبات کوانتومی نبودن.

حالا این مقاله یه راهحل کاملاً نو معرفی کرده که کلی با حال و آینده سازه! اومدن روشی تحت عنوان «یادگیری فدرال کوانتومی-الهام گرفته»، یا به قول خودشون Federated Quantum-Inspired Learning، برای کشف خطاها پیادهسازی کردن.

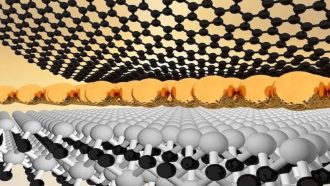

یادگیری فدرال یعنی مدل یادگیریای که هرکسی (یا هر کامپیوتر/مشتری که بهش میگن client) اطلاعاتشو پیش خودش نگه میداره و به جای اینکه خود داده رو بفرسته مرکزی (سرور)، فقط یه سری خلاصه از یادگیریش (مثل وزن و پارامترهای مدل شبکه عصبی) میفرسته سرور. اینطوری هرکسی اطلاعات محرمانهش پیش خودش میمونه و فقط نتیجهی آموزش خودشو با بقیه به اشتراک میذاره. مثلا یادت باشه: Client همون کاربر یا دستگاهیه که خودش مسئول یه تیکه از کار و دادهست!

توی این سیستم، هر client جداگانه روی دیتای مخصوص خودش شبکه عصبی میسازه و آموزش میده. بعد نتیجهی یادگیری رو (نه خود دادهها رو!) به سرور میفرسته. اون سرور با یه الگوریتم معروف به FedAvg (یعنی کلاً معدل گرفتن یا جمعبندی میانگین از همه مدلها)، پارامترارو جمع میکنه و یه مدل کلی بهتر میسازه و دوباره میفرسته برای هر client که یه دور دیگه آموزش بدن. این چرخش همینطور ادامه پیدا میکنه.

حالا چرا میگیم quantum-inspired؟

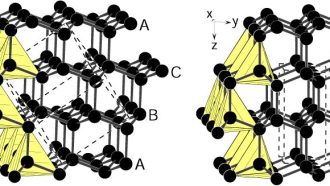

یعنی الهامگرفته از الگوریتمها و روشهای محاسباتی که تو دنیای کوانتوم استفاده میشن، بدون اینکه واقعاً خودشون تجهیزات کوانتومی داشته باشن. یعنی هماکنون بیشتر بر اساس همون یادگیری عمیق (deep learning) کلاسیک کار میکنه اما پایهاش جوریه که بعداً بدون مشکل میشه الگوریتمها یا سختافزار کوانتومی (quantum computing) بهش اضافه کرد. محاسبات کوانتومی یعنی کامپیوترهایی که به جای صفر/یک، از مفاهیم کوانتومی مثل Qubit استفاده میکنن که میتونن همزمان چند حالت رو داشته باشن و باعث سرعت و امنیت بیشتر میشن.

نتایجش چی شد؟

این سیستم تونست تا ۷۹٪ دقت تو کشف ناهنجاریها داشته باشه! جالب اینکه هیچ تیکهای از داده خصوصی هیچکسی بین clientها رد و بدل نشد و حریم خصوصی کاملاً حفظ شد. این موضوع واسه حوزههایی که اطلاعات خاص و حساسی دارن (مثل امنیت سایبری، بانکداری، یا حوزه سلامت) خیلی مهمه – چون کسی نمیخواد اطلاعاتش درز پیدا کنه.

در کل، این رویکرد جدید هم حریم خصوصی دادهها رو تضمین میکنه، هم قابلیت گسترش داره، و هم آمادست تا بعدا با پیشرفت علم کوانتوم، یکپارچهتر و امنتر بشه. اگه قراره هوش مصنوعی و یادگیری ماشین روزی واقعاً تو جاهایی مثل بانکها یا بیمارستانا کاربردی بشه، اینجور مدلها که هم distributed کار میکنن، هم privacy رو رعایت میکنن و هم آمادهی آینده هستن، واقعاً گزینههای جذابی هستن.

خلاصه، این مدل نشون میده میشه بدون اینکه واسه یادگیری الگوریتمها، اطلاعات شخصی رو قربانی کنیم، از قدرت هوش مصنوعی بهره ببریم، و حتی برای آینده با ورود کوانتوم آماده باشیم!

منبع: +