خب بچهها بیاید درباره یه موضوع جذاب حرف بزنیم که کلی هم تو دنیای آموزش سر و صدا کرده: اینکه چجوری میشه با استفاده از هوش مصنوعی و دادهکاوی، کمک کنیم یادگیری برای هر دانشآموز شخصی بشه و حتی اونایی که احتمالاً دارن عقب میافتن رو سریعتر پیدا کنیم، ولی همزمان به حریم خصوصیشون هم احترام بذاریم. ماجرا دقیقاً همینجاست که سخت میشه!

تو کشورهایی مثل برزیل، قانونی مثل LGPD هست که دقیقاً مثل GDPR تو اروپاست و خلاصه میخواد خیال همه رو راحت کنه که دادههای حساس، مثل اطلاعات دانشآموزا، یهو نره دست همه و لو نره! پس داشتن یه مدل مرکزی که همه اطلاعات رو یه جا جمع کنه، تقریباً غیرممکن میشه. LGPD هم یعنی همون قانون حمایت از دادههای شخصی تو برزیل که مواظبه اطلاعات مردم تو کنترل باشه.

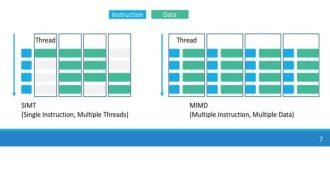

حالا تکنولوژیها شروع کردن زیرپوستی راه حل پیدا کردن! یه راهحل خفن اومده به اسم Federated Learning! اگه بخوام سادهتر بگم، Federated Learning یعنی یادگیری فدراته، که توش قرار نیست تمام دادهها تو یه سرور مرکزی جمع بشن. هر کی همونجا که خودش هست (مثلاً تو مدرسه خودش) مدل رو آموزش میده و فقط نتایج یادگیری رو میفرسته وسط، پس اطلاعات محرمانه لو نمیره.

تو این مقاله، اومدن بررسی کردن ببینن پیشبینی عملکرد درسی دانشآموزا تو سیستم آموزشی برزیل با این روش چطور جواب میده. دیتایی که استفاده کردن، مربوط میشه به SAEB، که اسم کاملش Brazilian Basic Education Assessment System هست—یه جور سامانه ملی ارزشیابی تو برزیل که اطلاعات کلی دانشآموزا رو ثبت میکنه.

دو تا مدل رو تست کردن:

- یه مدل متمرکز به اسم XGBoost که همه اطلاعات رو تو یه جا جمع میکنه (ولی خب تو عمل بخاطر قانون LGPD شدنی نیست، اما برای مقایسه خوبه.)

- یه مدل فدراته به اسم FedProx که بر اساس Deep Neural Network ساخته شده. معنی Deep Neural Network هم اگه تا حالا نشنیدین، همون شبکه عصبی چند لایه هست که الهام گرفته از مغز انسان خیلی باهوش کار میکنه یا دست کم اینطوری میگن!

سناریو رو اینطوری فرض گرفتن که ۵۰ تا مدرسه دارن دادههاشون رو، بدون اینکه جا به جا کنن، مدل خودشون رو آموزش میدن و فقط نتیجه کار رو وسط میذارن.

حالا نتیجه چی شد؟ فکر کن دادههای مربوط به بیش از دو میلیون دانشآموز رو بررسی کردن! مدل متمرکز با XGBoost تونست با دقت ۶۳.۹۶٪ عملکرد رو پیشبینی کنه. مدل فدراته FedProx هم با اینکه یه کوچولو عقبتر بود، رسید به دقت ۶۱.۲۳٪. یعنی فقط حدود دو درصد پایینتر، اما در عوض دیگه مشکل حفظ حریم خصوصی هم نداشت!

در نهایت نتیجه گرفتن که Federated Learning (همون یادگیری فدراته) واقعاً میتونه راهحل مناسبی برای ساخت مدلهای پیشبینی عملکرد دانشآموزا باشه، بدون اینکه بخواد خلاف قوانین حریم خصوصی عمل کنه. همین موضوع مخصوصاً تو برزیل، به خاطر حساسیتهای LGPD، کلی ارزش داره. به عبارت دیگه، نه تنها میشه با این روش مدلهای قوی ساخت، بلکه دانشآموزا و پدر مادرشون هم خیالشون راحته که اطلاعاتشون امن میمونه.

منبع: +