خب، اگه توی دنیای هوش مصنوعی (AI یعنی همون هوش مصنوعی که سعی میکنه کارهای پیچیده انسان رو انجام بده) اهل خبر و دنبال کردن هستی، حتماً خبر اومدن GPT-5 دستت رسیده! کلی سر و صدا کرد و همه انتظار داشتن که یه قدم بزرگ تا هوش عمومی مصنوعی (Artificial General Intelligence یعنی هوشی که مثل یه آدم واقعی همهکاره باشه) برداشته باشیم و دنیا رو متحول کنه. ولی بیاید یه نگاه خودمونی بندازیم که واقعاً چه اتفاقی افتاد و چه چیزهایی پشت سر این داستانه.

سام آلتمن، مدیرعامل OpenAI (همون شرکتی که مدلهای ChatGPT رو ساخت)، قبل از معرفی GPT-5 گفته بود که با دیدن قدرت این مدل احساس “بیفایده بودن” میکنه، و حتی حس کاری که دانشمندای بمب اتم انجام دادند رو بهش دست میده! واقعاً اینقدر ترسناک و عجیب بوده؟ خب، بعد از رونمایی، باید بگم نه، خیلی هم اونقدرها اعجابانگیز نبود.

همون اول کار ملت کلی اشتباه عجیبوغریب ازش پیدا کردن! مثلاً تو جواب دادن به سوالات ساده یا حتی تخصصی، بعضی وقتا جوابای گمراهکننده یا غلط میداد. سام اول گفته بود که این مدل “در حد یه دکترای واقعی تو هر زمینهای هر سوالی رو جواب میده” اما معلوم شد اونقدرها هم دقیق نیست. تازه یه ویژگی جدید گذاشته بودند که خودش تشخیص بده چه مدلی برای سوال شما بهتره؛ مثلاً سوال پیچیده یه مدل منطقیتر جواب بده و سوال ساده رو سریعتر جواب بده. ولی اینم بازم درست کار نکرد و خود آلتمن هم غیرمستقیم قبول کرد که این قابلیت هم هنوز مشکل داره و در واقع اختیار کاربر رو هم کمتر کرده.

اما یه چیز مثبت هم هست! برخلاف نسخۀ قبلی، GPT-5 دیگه بیخودی از کاربرا الکی تعریف و تمجید نمیکنه (یعنی اون رفتار چاپلوسانه کمتر شده). ولی در کل، بیشتر شبیه یه بروزرسانی ساده و شکیل برای چت کردن با ChatGPT شده تا یه انقلاب بزرگ تو هوش مصنوعی.

حالا یه اتفاق جالب دیگه: قبلاً شرکتهای سازنده مدلهای هوش مصنوعی فقط روی اینکه مدلهاشون باهوشتر بشه کار میکردن و از کاربرد زیاد حرفی نمیزدن. مثلاً دوست داشتن بشه همزمان شعر بنویسه هم شیمی آلی رو بلد باشه! ولی جدیداً استراتژی عوض شده. الان بیشتر سعی میکنن مدلهاشون رو تو زمینههای خاص مثل کدنویسی یا کارهای پزشکی تبلیغ کنن (حتی اگه شواهد نشون بده هنوز نمیتونن جای برنامهنویسا یا پزشکا رو بگیرن!). به نظر میاد چون پیشرفت بزرگ تو مدلهای زبانی ایجاد نشده، حالا شرکتا میخوان با همین چیزی که دارن، کاربردهای بیشتر تو بخشهای مختلف درست کنن.

یکی از خیلی واضحترین مثالهاش تو GPT-5 اینه که تشویق میکنن مردم ازش برای مشاوره پزشکی استفاده کنن! قبلاً اگه از ChatGPT سوال پزشکی میپرسیدی، کلی تذکر میداد که “من دکتر نیستم” و بعضی سوالا رو اصلاً جواب نمیداد. اما حالا نهتنها به راحتی جواب میده، حتی عکس رادیولوژی (مثل تصویر ماموگرافی) رو هم برات تفسیر میکنه و دنبال جوابهای بیشتر ازت سؤال میپرسه تا به تشخیص برسه!

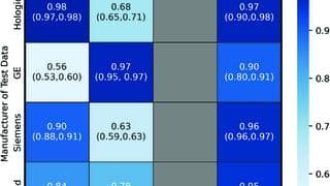

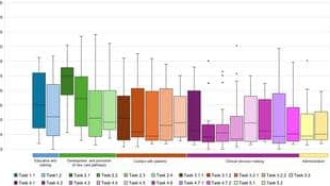

اردیبهشت امسال، OpenAI اومداز پروژه HealthBench رونمایی کرد. HealthBench یعنی یه راه برای آزمایش اینکه AIها تو مسائل پزشکی چقدر خوب عمل میکنن، اونم با نظر پزشکا. تو تیر، یه مطالعه هم منتشر کردن که توش پزشکای کنیا با کمک مدل AI کمتر تو تشخیص اشتباه داشتن! اینم خیلی تبلیغش کردن. حتی تو مراسم رونمایی GPT-5، یکی از کارمندای OpenAI با همسرش که سرطان داشته رو آوردن روی صحنه. خودش اومد از تجربهش گفت که اطلاعات پزشکی رو به چتبات داده تا براش توضیح بده و کلی تصمیمگیری مهم مثل انجام دادن یا ندادن رادیوتراپی رو با کمک AI انجام داده. خلاصه یکم قضیه رو شبیه یه پیروزی برای آدمای معمولی نشون دادن که حالا دسترسی به اطلاعات پزشکی دارن.

اما خب این یه لبه خطرناک داره! چون OpenAI داره با استناد به پژوهشهایی که نشون میده AI میتونه به پزشکها کمک کنه، مردم عادی رو تشویق میکنه که برای سلامت خودشون مستقیم سراغ مدل AI برن. مشکل اینجاست که خیلیا دیگه اصلاً پیش دکتر نمیرن و چون دیگه سیستم اخطار دادن چتبات هم تقریباً حذف شده، هرچی مدل بگه رو عمل میکنن.

یه نمونهاش فقط دو روز قبل از معرفی GPT-5 تو ژورنال Annals of Internal Medicine چاپ شد: یه نفر به حرف ChatGPT گوش کرد و نمک رو کامل حذف کرد و به جاش مقدار زیادی مادهای به اسم بروماید (Bromide یعنی یه ماده شیمیایی که قبلاً تو داروها استفاده میشد) مصرف کرد، که باعث مسمومیت شدید شد. این مشکل تو آمریکا بعد از دهه ۷۰ تقریباً برطرف شده بود اما این بنده خدا نزدیک بود بمیره!

در واقع نکته اصلی اینه که وقتی AIها وارد حوزههایی مثل پزشکی میشن، موضوع مسئولیت پیش میاد: اگه یه دکتر بهت مشاوره بد بده و آسیبی بزنه، میشه ازش شکایت کرد و مثلاً جبران خسارت گرفت (که بهش میگن malpractice). ولی اگه یه چتبات مثل ChatGPT به خاطر آموزش اشتباه، سوگیرانه بودن دادهها یا همون “هالوسینیشن” (یعنی اطلاعات ساختگی و اشتباه دادن که بعضی وقتا سیستمهای AI از خودشون درمیارن)، یه مشاوره وحشتناک بده کی جوابگوئه؟ فعلاً هیچ نشونهای از این نیست که شرکتها مسئولیت حقوقی جدی قبول کنن!

خلاصه داستان اینه: GPT-5 اونقدر که فکر میکردیم خارقالعاده نیست، اما راه و روش تبلیغش داره عوض میشه و بیشتر به سمت استفادههای پرریسک مثل پزشکی میره. خیلی باید مراقب بود چی ازش میپرسی و چقدر به جوابهاش اطمینان میکنی، چون فعلاً اگه چیزی بشه، خیلی راحت نمیتونی از کسی حقتو بگیری!

منبع: +