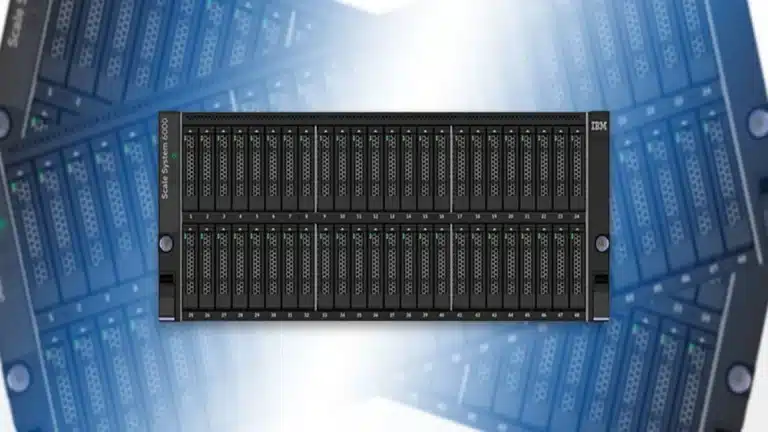

اگه فکر میکردین ظرفیت سرورها و سیستمهای ذخیرهسازی دیگه تهش رسیده، باید بهتون بگم IBM یه حرکت خفن زده! حالا با آپدیت جدیدی که برای سیستم Storage Scale System 6000 داده، میتونن تو یه رک کامل، تا ۴۷ پتابایت (یعنی ۴۷,۰۰۰ ترابایت!) اطلاعات نگه دارن. این یعنی سه برابر چیزی که قبلاً ممکن بود – ترکوندن حسابی!

حالا این ماجرا بیشتر به درد کیها میخوره؟ اونا که سر و کارشون با حجم عظیم دادهست، مثلاً تیمهایی که کارهای سوپرکامپیوتری (یعنی کارهایی با پردازش بسیار سنگین مثل شبیهسازی علمی یا هوش مصنوعی) دارن انجام میدن یا سرویسهای ابری که همیشه باید کلی دیتا جابجا کنن.

آپدیت اصلی این سری، استفاده از یه جعبهی جدید به اسم All-Flash Expansion Enclosure هست که توش از QLC flash drive هایی با ظرفیت بالای ۱۲۲ ترابایت استفاده شده. QLC flash drive یعنی حافظهای مشابه SSDهای معمول، ولی با تراکم خیلی بالاتر برای ذخیره اطلاعات. حالا این Enclosure کم حجم (فقط ۲ یونیت از رک رو اشغال میکنه) میتونه تا ۲۶ تا از این درایوها و حتی ۴ تا DPU مدل Nvidia BlueField-3 رو تو خودش جا بده. DPU رو هم اگه نمیدونین، همون پردازندههای مخصوص شبکه و دیتا هستن که کارشون کمک به پردازش دیتا مستقلاً از CPU و GPU عادیه.

این قضیه باعث شده سیستم IBM بدون اینکه توی سرعت یا عملکردش گره و مشکل (همون bottleneck معروف) پیش بیاد، همزمان چندتا پردازش داده حجیم رو هندل کنه. یعنی اگه تا حالا به خاطر محدودیت حافظه یا سرعت توی پروژههای هوش مصنوعی یا شبیهسازی به مشکل میخوردین، دیگه خبری از اون داستانا نیست!

یه نقطهی کلیدی اینکه این Enclosure لایه کش خیلی گندهای داره که باعث میشه اطلاعات فعال–ویژه اونایی که لازمه نزدیک GPUها باشه–همیشه دم دست باقی بمونه و اینطوری فرایندها بدون توقف جریان پیدا کنن. Cache اینجا یعنی حافظهای که دادههای حیاتی رو سریعتر از هارد معمولی به پردازندهها میرسونه.

از نظر ارتباطات هم خیالتون راحت: پشتیبانی از سویچهای اترنت Nvidia Spectrum-X رو داره که باعث میشه وقتی نیاز دارین تو هوش مصنوعی مدلها رو هر دفعه چکپوینت کنین، این مرحله خیلی سریعتر انجام بشه. (چکپوینت کردن یعنی ذخیره آخرین وضعیت محاسبات وسط کار، تا اگه مشکلی پیش اومد از همونجا ادامه بدی.)

اما این سیستما فقط با سختافزار قوی کار نمیکنن؛ نرمافزار هم باید هماهنگ باشه. IBM نسخه ۷.۰.۰ از نرمافزارش رو هم داده که الان با این حجمهای عجیب سازگار شده. قابلیت جدیدی که بهش اضافه کردن Erasure Coding با پیکربندی 16+2 هست (یعنی اطلاعات رو تیکه تیکه ذخیره میکنه که اگه یکی دوتا تیکه خراب شد، بقیه دیتا سالم بمونه) که خیلی بازده رو بالا میبره.

از لحاظ قدرت و سرعت، برخلاف قبل که چهار رک میتونستن تا ۲.۲ پتابایت و تا ۱۳ میلیون IOPS (یعنی تعداد ورودی/خروجیهای سریع در ثانیه) و سرعت خوندن ۳۳۰ گیگابایت بر ثانیه بدن، الان با یه رک، سقف IOPS رفته تا ۲۸ میلیون و سرعت خوندن تا ۳۴۰ گیگابایت بر ثانیه! یعنی تو کارای سنگین مثل آموزش مدل هوش مصنوعی و پردازش موازی (parallel processing – پردازش همزمان دادهها رو چند پردازنده) واقعاً دستتون بازه.

جذابتر اینکه این معماری جوری ساخته شده که اگه CPU سیستمهاتون هم زیر فشار شدید برن (مثلاً تو پنجرههای زمانی با پردازش بالا)، باز انتقال دیتا بین نودها (سرورها توی یک خوشه) بدون تاخیر و خیلی پایدار انجام میشه. نود یا Node یعنی هرکدوم از سرورهای مستقل که همراه هم کار میکنن.

در کل، هدف IBM این بوده که با حرکت جدید سه چیز رو با هم درست کنه: چگالی داده (یعنی حجم ذخیرهسازی تو فضای کم)، مدیریت سادهتر حجمهای عظیم دیتا و اینکه بتونی انواع مختلف کار (Workload) رو همزمان و بی استرس هندل کنی. البته همهی اینا رو باید بندازیم بیرون از آزمایشگاه و ببینیم تو دنیای واقعی وقتی حجم کارها زیاد شه، چجوری جواب میده.

خلاصه: اگه دنبال سیستم ذخیرهسازی خیلی پرظرفیت میگردی که هم سریع باشه، هم بتونه بار سنگین انواع پروژههای هوش مصنوعی، ابررایانه، یا حتی سرویس ابری رو بکشه، آپدیت جدید IBM دقیقاً همون چیزیه که باید بهش یه نگاه جدی بندازی!

منبع: +