مدلهای زبانی بزرگ (Large Language Models: LLMs) مانند مدلهای شرکت اوپنایآی (OpenAI)، با ارائه استدلال پیشرفته، وظایف پیچیدهای مانند ریاضی، کدنویسی و منطق را متحول کردهاند. این پیشرفتها از طریق تکنیکهایی نظیر استدلال زنجیره فکری (Chain of Thought: CoT) و یادگیری تقویتی (Reinforcement Learning: RL) به دست آمده و مرزهای هوش مصنوعی را به شیوهای نوآورانه گسترش دادهاند. بیاموزید چگونه استدلال پیشرفته مدلهای زبانی بزرگ، مسیرهای جدیدی در حل چالشهای پیچیده ایجاد میکند.

چگونه مدلهای زبانی بزرگ، استدلال را پیش میبرند

تحولات اخیر در مدلهای زبانی بزرگ (LLMs) نحوه برخورد هوش مصنوعی با وظایف پیچیده، از حل مسائل پیچیده ریاضی گرفته تا تولید کد کارآمد، را تغییر داده است. در حالی که این مدلها از دستیابی به هوش مصنوعی عمومی (Artificial General Intelligence: AGI) فاصله زیادی دارند، قابلیتهای استدلال آنها نشان دهنده یک جهش فوقالعاده رو به جلو است. آخرین نسخه اوپنایآی (OpenAI)، مدل o1، نمونهای از این پیشرفت است که نتایجی چهار برابر بهتر از GPT-4o در معیارهای کدنویسی را ارائه میدهد. اما چه چیزی دقیقاً این امر را ممکن میسازد؟

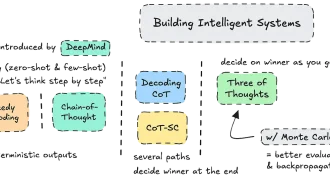

بیایید روشهای کلیدی محرک این پیشرفتها را بررسی کنیم: استدلال زنجیره فکری (Chain of Thought: CoT) و یادگیری تقویتی (Reinforcement Learning: RL).

نقطه عطف: استدلال زنجیره فکری (Chain of Thought: CoT)

مدلهای زبانی بزرگ (LLMs) سنتی کلمه بعدی را در یک دنباله پیشبینی میکنند، که برای کارهای ساده مانند نوشتن یا خلاصهسازی به خوبی عمل میکند. با این حال، این رویکرد هنگام اعمال بر روی مسائل پیچیدهتر که نیاز به تفکر منطقی گام به گام دارند، با مشکل مواجه میشود. وارد استدلال زنجیره فکری (Chain of Thought: CoT) شوید.

-

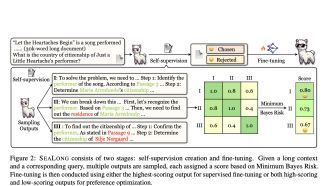

نحوه کار CoT:

CoT مدلها را قادر میسازد تا مسائل پیچیده را به مراحل کوچکتر و قابل مدیریت تقسیم کنند. این روش نحوه برخورد انسان با چالشها را با حل و فصل مسائل به صورت متوالی منعکس میکند. این استدلال ساختاریافته به مدلها اجازه میدهد تا وظایف را در ریاضی، کدنویسی و منطق با دقت قابل توجهی انجام دهند. -

مثالهای دنیای واقعی:

مدل o1 شرکت اوپنایآی (OpenAI) از CoT برای برتری در زمینههایی مانند اشکالزدایی کد یا حل اثباتهای ریاضی استفاده میکند. مدلهای دیگر، مانند Gemini گوگل و Claude شرکت Anthropic، نیز از تکنیکهای CoT برای بهبود قابلیتهای حل مسئله در برنامههای مختلف استفاده میکنند.

با ادغام استدلال زنجیره فکری (CoT)، این مدلها اکنون به طور سیستماتیکتر «فکر» میکنند و آنها را در انجام وظایفی که زمانی فراتر از محدوده آنها به نظر میرسید، بسیار مؤثرتر میکند.

یادگیری تقویتی (Reinforcement Learning: RL): موتور تکامل منطقی

یکی دیگر از ارکان بهبود استدلال در مدلهای زبانی بزرگ (LLMs)، یادگیری تقویتی (Reinforcement Learning: RL) است. این تکنیک فراتر از تکرار صرف الگو است و مدلها را قادر میسازد تا تواناییهای استدلال خود را به صورت پویا اصلاح کنند.

نحوه کار یادگیری تقویتی:

-

نظارت بر نتیجه:

مدل بر اساس اینکه آیا پاسخ نهایی آن صحیح است، بازخورد دریافت میکند. این امر به ویژه برای مسائلی با نتایج واضح درست یا غلط، مانند حل معادلات یا پاسخ به سوالات بیاهمیت، موثر است. -

نظارت بر فرآیند:

ارزیابهای انسانی هر مرحله از فرآیند فکری مدل را بررسی میکنند و اطمینان حاصل میکنند که منطق آن با نتایج مطلوب مطابقت دارد. این اصلاح دقیق به مدل کمک میکند تا در کارهای استدلال پیچیده بهتر حرکت کند.

چرا RL اهمیت دارد:

با ترکیب نظارت بر نتیجه و فرآیند، مدلهایی مانند o1 شرکت اوپنایآی (OpenAI) نه تنها یاد میگیرند که پاسخهای صحیح را تولید کنند، بلکه مراحل استدلال داخلی خود را نیز بهبود میبخشند. این یک سیستم ایجاد میکند که قادر به مقابله با چالشهای پیچیدهای مانند:

- نوشتن کد بهینه و کاربردی.

- اشکالزدایی خطاها در برنامهنویسی.

- حل مسائل ریاضی چند مرحلهای.

کاربردهای عملی استدلال پیشرفته مدل زبانی بزرگ (LLM)

قابلیتهای استدلال پیشرفته مدلهای زبانی بزرگ (LLMs) در حال حاضر در حوزههای مختلف موج ایجاد میکند:

-

کدنویسی و توسعه نرمافزار:

هنگامی که وظیفه حل مسائل پیچیده برنامهنویسی به مدلهایی مانند o1 داده میشود، آنها مسئله را تجزیه میکنند، راهحلهای کد تولید میکنند، خطاها را اشکالزدایی میکنند و خروجی را بهینه میکنند. این استدلال گام به گام به توسعهدهندگان اجازه میدهد تا چالشهای پیشرفتهتر را به طور موثر مدیریت کنند. -

ریاضیات و اثباتهای منطقی:

با استفاده از CoT و RL، مدلهای زبانی بزرگ (LLMs) مسائل پیچیده ریاضی را با دقت حل میکنند. آنها میتوانند هر مرحله از راه حل را با جزئیات شرح دهند و شفافیت را در فرآیند استدلال خود ارائه دهند. -

حل مسئله روزمره:

در حالی که این مدلها برای کارهای پیچیده طراحی شدهاند، میتوانند در مورد سوالات سادهتر بیش از حد فکر کنند. با این حال، توانایی آنها در استدلال از طریق مسائل چندوجهی، آنها را برای کاربردهایی که فرآیندهای فکری ساختاریافته ضروری هستند، ایدهآل میکند.

آینده استدلال در هوش مصنوعی

ترکیب استدلال زنجیره فکری (CoT) و یادگیری تقویتی (RL) نقطه عطفی در توسعه هوش مصنوعی است. این روشها به مدلها اجازه میدهند فراتر از تکرار الگوهای حفظ شده بروند و آنها را قادر میسازند تا به طور فعال در مورد مسائل «فکر» کنند.

با این حال، چالشها همچنان باقی هستند. برای مسائل سادهتر، مدلهای استدلال پیشرفته گاهی اوقات راهحلها را بیش از حد پیچیده میکنند یا کاملاً هدف را از دست میدهند. با ادامه تکامل هوش مصنوعی، اصلاح زمان و نحوه اعمال این فرآیندهای استدلال بسیار مهم خواهد بود.

به طور خلاصه، مدلهای زبانی بزرگ (LLMs) نه تنها از نظر اندازه، بلکه از نظر هوش نیز در حال رشد هستند. تکنیکهایی مانند CoT و RL راه را برای سیستمهای هوش مصنوعی هموار میکنند که میتوانند بیشتر شبیه انسان فکر کنند – تجزیه مسائل، ارزیابی راهحلها و یادگیری از اشتباهات خود. آینده نوید گامهای بزرگتری را در قابلیتهای استدلال میدهد و امکانات جدیدی را برای هوش مصنوعی در صنایع مختلف باز میکند.

اگر به خواندن کامل این مطلب علاقهمندید، روی لینک مقابل کلیک کنید: linkedin.com