خوب بچهها، بذارین براتون یه داستان جالب تعریف کنم راجع به چطور میشه مطمئن شد که محتواهایی که تو شبکههای اجتماعی یا پلتفرمهای مختلف منتشر میشن، واقعاً با قوانین برند، قانون و حتی سیاستهای خود پلتفرمها هماهنگ هستن. این قضیه خیلی مهمه، مخصوصاً الان که محتوا دیگه فقط متن نیست، تصویری و صوتی و همه چی با هم قاطیه!

تا الآن شرکتها برای بررسی یا «کامنلاین» بودن محتواها (Compliance یعنی همون منطبق بودن روی یه سری قواعد) کلی سیستم مختلف داشتن. مثلاً یه بخش برای تشخیص تصویر درست میکردن، یکی دیگه از متن عکسها میکشید بیرون، از صداها هم پیادهسازی میگرفتن (یعنی صدا رو میکردن متن)، بعد دستی یه سری چک انجام میدادن و آخرش هم همه این ماژولها رو با قانونها قاطی میکردن تا ببینن محتوا اوکی هست یا نه. معلومه همچین سیستمی خیلی دردسر داره، کلی هزینه و انرژی میبره، وقتی هم قوانین جدید بیاد باید کلی چیز رو از نو درست کنن.

اینجاست که هوش مصنوعی چند-مدلی یا همون Multimodal Large Language Models (MLLMs) وارد میشه؛ یعنی مدلهایی که همزمان میتونن با تصویر و متن (و گاهی صدا) کار کنن. اینا واقعاً دنیای محتوا رو تکون دادن! حالا تیمی اومده یه چارچوب جدید به اسم M-PACE ساخته که واقعاً همه این مسیرای سخت رو یکجا جمع کرده و اصل کار رو آسون کرده.

یه توضیح راجع به اسمش هم بدم: M-PACE مخففِ «Multimodal Parameter Agnostic Compliance Engine»ـه. یعنی یه موتور بررسی مطابقت که به همه مدلهای مختلف هوش مصنوعی کاری نداره، خودش میتونه همه رو هندل کنه!

توی این چارچوب، دیگه لازم نیست اون همه ماژول جدا و سیستمهای تکهتکه بسازی. کافیه همه اطلاعات رو (متن و تصویر و هر چی هست) بدی به این M-PACE و اون توی یه دور همه رو تحلیل میکنه و نظر میده که مطابقت داره یا نه.

حالا اینا یه استفاده جذابش هم آوردن: مثلاً برای تبلیغات، چون اونجا همهچیز حساسه. اومدن بیشتر از ۱۵ تا ویژگی مربوط به قوانین و استانداردهای تبلیغات رو بررسی کردن و نشون دادن که سیستمشون میتونه کاملاً این موارد رو تشخیص بده.

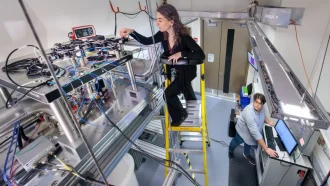

یکی از چیزای باحال این است که تیم سازنده برای تست M-PACE یه دیتاست مخصوص ساختن که توش کلی نمونه شبیه زندگی واقعی هست. مثلاً جاهایی که تصویر تار یا جلوی متن گرفته شده یا حتی حرفهای بیادبانه (profanity) وارد شده. اینجوری مطمئن شدن که سیستم واقعا تو هر شرایطی خوب کار میکنه.

یه مدل خیلی جالب «مادر-فرزند» هم دارن تو M-PACE. یعنی مثلاً یه مدل قویتر نقش مادر رو بازی میکنه و خروجی مدلهای سبکتر رو ارزیابی میکنه. اینجوری کارها تا حد زیادی اتوماتیک میشه و نیاز به آدمها برای بررسی کاهش پیدا میکنه! یعنی کنترل کیفیت دیگه بیشتر دست هوش مصنوعیه.

از طرف دیگه، تو نتایجشون نشون دادن که هزینه تحلیلهاشون (همون چیزی که بهش میگن inference cost، یعنی هزینه پردازش مدل تو هر تصویر یا محتوا) بیشتر از ۳۱ برابر توسط M-PACE کاهش پیدا کرده! مثلاً اگه یه مدل قوی مثل Gemini 2.5 Pro برای هر تصویر ۰.۰۱۵۹ دلار هزینه داشت، اینا تونستن با مدل کارآمدترشون و مادر-فرزندش (که اسمش Gemini 2.0 Flash هست) این رو به ۰.۰۰۰۵ دلار برسونن؛ بدون اینکه دقت پایین بیاد! خلاصه یعنی با هزینه خیلی کمتر همون سطح کیفیت رو تحویل میگیرن؛ و این حرفهاشون فقط روی کاغذ نیست، در عمل و روی دادههای واقعی تبلیغاتی جواب داده.

در نهایت، اگه بخوای خیلی خلاصه بگی: M-PACE رو آوردن تا کار بررسی و همخوانی محتوا رو ساده، سریع و مقرون به صرفه کنن. دیگه مجبور نیستیم هزارتا سیستم جدا درست کنیم و هی نگران هماهنگیشون باشیم. همهچیز تو یه سیستم جمع شده و زندگی رو برای شرکتها، برندها و حتی پلتفرما آسونتر و کمخرجتر کرده.

پس دفعه بعدی که تبلیغی دیدی و مطمئنی نه عکسش ممنوعه، نه متنش حرف زشتی توشه و نه سیاستای پلتفرم رو به هم زده، بدون شاید پشت ماجرا همچین هوش مصنوعیهایی دارن کار میکنن!

منبع: +