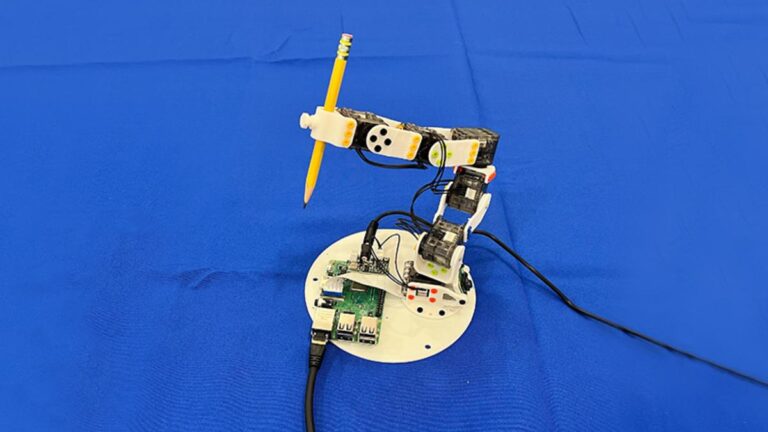

خب بیا برات یه داستان جالب و عجیب از MIT تعریف کنم! یه تیم دانشمند توی MIT یه هوش مصنوعی ساختن که میتونه تقریباً هر رباتی رو فقط با دیدن، خودش کنترل کردن رو یاد بگیره، اونم بدون نیاز به هیچ سنسوری یا آموزش اولیهای! یعنی دیگه نه خبری از هزار تا سیم و سنسور گرونه، نه لازمه یکی روزها و ساعتها بشینه ربات رو برنامهریزی کنه.

حالا چجوری کار میکنه؟ دانشمندها گفتن ایدهشون این بوده که همونطور که ما آدما با چشمهامون میفهمیم بدنمون چطوری حرکت میکنه، این سیستم هم با یه دوربین، به ربات نگاه میکنه و یاد میگیره خودش رو توی فضا کنترل کنه. یعنی مثلاً انگار ربات یه چشم داره که خودشو تو آینه میبینه و کمکم یاد میگیره هر کاری انجام بده چه بخشی از بدنش جابجا میشه!

کل داستان اینه که اونا یه شیوه جدید به اسم “نقشهبرداری میدان ژاکوبی” درست کردن. حالا شاید بپرسی میدان ژاکوبی چیه؟ یه مدل ریاضی-تصویریه که مکان دقیق نقاط بدن ربات رو تو فضای سهبعدی نشون میده و کمک میکنه بفهمه با هر حرکت، کدوم عضو دقیقاً کجا میره. این باعث میشه کنترل هر ربات تبدیل بشه به یه بازی کاملاً انعطافپذیر و سریع!

یه قسمت باحال ماجرا اینجاست که این روش تو رباتهایی که ساختارشون خیلی فرق داره یا از مواد نرم ساخته شدن – مثلاً همون soft robotics که توش به جای فلز از پلاستیک یا چیزای نرم استفاده میشه – هم خیلی خوب جواب داده. فقط چند ساعت آموزش با دوربین کافی بوده تا این رباتها خودشون آزاد و مستقل حرکت کنن.

یکی از محققای اصلی پروژه، Sizhe Lester Li، خودش گفته: «میدونی، ما وقتی بچه بودیم برای اینکه بفهمیم انگشتامون چطوری کار میکنه هی تکونشون میدادیم و نگاه میکردیم که چی تکون میخوره. این هوش مصنوعی هم دقیقاً همین کار رو میکنه: کارهای تصادفی انجام میده و میفهمه هر کنترلر چیکار میکنه.»

تا قبل از این داستان، کنترل رباتها حسابی پیچیده و گرون بود: باید دهها و گاهی صدها ساعت یه مهندس حرفهای وقت میذاشت تا ربات بر اساس هزاران سناریوی مختلف برنامهریزی بشه، تازه سنسورهای ریز و گرون هم لازم داشت. مثلاً گرفتن اجسام با انگشتای شبیه دست انسان هنوزم کلی چالش داره! اما الان با این روش جدید میتونی فقط با ویدیو گرفتن از حرکات ربات و نگاه کردن، کاری کنی که خودش همهچی رو بفهمه.

روش جدید MIT اینطوریه: فقط دوتا تا سه ساعت ویدیو میگیرن از ربات (اونم با ۱۲ تا دوربین معمولی RGB-D — یعنی دوربینهایی که هم تصویر RGB میگیرن هم عمق رو حساب میکنن، مثل همون کینکت خودمون). و تو این مدت ربات شروع میکنه حرکات تصادفی انجام بده، دوربینها ثبت میکنن، بعد هوش مصنوعی اطلاعات رو میخونه و مدل سهبعدی خودش رو میسازه.

فریمورک یا چارچوب این برقآسا دوتا بخش اصلی داره:

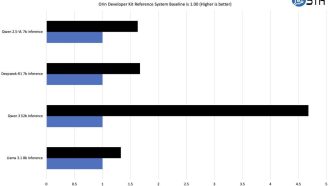

۱- مدل یادگیری عمیق (deep learning) که کمک میکنه ربات جای خودش و دست و پاش رو توی فضای سهبعدی متوجه بشه. یعنی مثلاً خودش بفهمه مغزش کجاست و دستش الان دقیقاً کدوم نقطه رو تو فضا اشغال کرده.

۲- بعد یه برنامه یادگیری ماشین (machine learning) که دستورات معمولی حرکتی، مثلاً “بردار دستتو بالا” رو تبدیل میکنه به زبانی که مغز ربات میفهمه و میتونه اجراش کنه.

نکته جالب اینه که این روش نه تنها دقیقتره بلکه وقتی توی محیط شلوغ و بههم ریخته (مثلاً وقتی جلوی ربات نیمهپوشیده یا پر از اشیاء اضافیه) هم مدل MIT از مدلهای قدیمی که فقط با ۲D کار میکردن بهتر جواب داد. قبلیها کلاً هنگ میکردن، اما این یکی تو همون شرایط هم یه نقشه سهبعدی دقیق درمیآورد و گیج نمیشد.

دانشمندها این روش رو ۲۵ ژوئن تو ژورنال معتبر Nature منتشر کردن. خودشون هم گفتن ایده اصلی این پروژه این بوده که مغز انسان چجوری فقط با بینایی میتونه هم خودش رو کنترل کنه، هم اشیاء اطرافش رو جابهجا کنه. مثلاً ما آدما میتونیم با دسته کنسول بازی تو چند دقیقه بفهمیم چجوری کلیپسی رباتی رو بگیریم و بذاریم سر جاش، بدون اینکه سنسور خاصی لازم داشته باشیم. این همون کاریه که این هوش مصنوعی جدید انجام میده، فقط با یه دوربین معمولی!

آخر کار هم، این مدل رو روی کلی ربات مختلف با ساختارهای کاملاً متفاوت تست کردن. جالب اینجا بود که دیگه اصلاً لازم نبود بعد از آموزش اولیه حتی یه بارم انسان بهش دخالت کنه. فقط با یه دوربین هم میتونست کل کنترل رو به دوش بگیره!

خلاصه بخوام جمعبندی کنم، MIT کاری کرده که آینده رباتها خیلی راحتتر و خودآموزتر باشه. شاید تا چند سال دیگه، کنترل کردن رباتها شبیه همین آموزش رانندگی مجازی با پلیاستیشن بشه، بدون دردسر و هزینههای اضافه. و این یعنی انقلاب تو رباتیک و هوش مصنوعی!

(اگه دوست داری بدونی چه اختراعات عجیبغریب دیگهای توی دنیای رباتیک دارن، مثلاً رباتهای بوکسور چینی یا پوست مصنوعیهایی که ازشون آتیش میگیرن یا برششون میدن تا ببینن حس دارن یا نه، حتماً این اخبار رو دنبال کن! دنیای آینده داره جالبتر از همیشه میشه!)

منبع: +