مدل زبانی لاما-۳_۱-نموترون-۵۱بی شرکت انویدیا (NVIDIA Llama-3_1-Nemotron-51B) پیشرفتی چشمگیر در فناوری مدلهای زبانی بزرگ محسوب میشود. این مدل با ترکیب کارایی و دقت از طریق طراحی معماری نوآورانه، به بهینهسازی عملکرد دست یافته است.

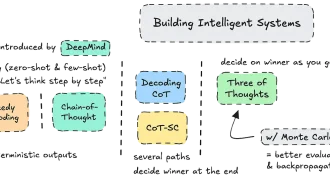

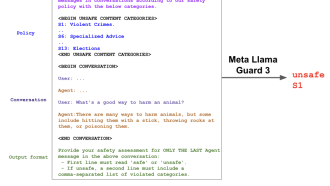

این مدل با استفاده از جستجوی معماری عصبی (Neural Architecture Search) و تقطیر دانش (Knowledge Distillation) روی ۴۰ میلیارد توکن آموزش دیده است. تمرکز اصلی آن بر کاربردهای گفتگوی تکمرحلهای و چندمرحلهای به زبان انگلیسی است. انویدیا با بهرهگیری از NAS، معماری سنتی مدلهای زبانی بزرگ را با حذف هوشمندانه اجزای غیرضروری مانند شبکههای پیشخور و مکانیسمهای توجه، بهینهسازی کرده است.

برای استقرار این مدل به منابع محاسباتی قابل توجهی نیاز است، از جمله:

– پردازنده گرافیکی A100 80GB یا H100

– ۱۵۰ گیگابایت فضای خالی دیسک

– حداقل ۱۰۰ گیگابایت حافظه رم

فرآیند پیادهسازی شامل راهاندازی یک ماشین مجازی مجهز به GPU است که ترجیحاً از طریق پلتفرمهایی مانند NodeShift که راهکارهای منطبق با GDPR، SOC2 و ISO27001 ارائه میدهند، انجام میشود.

اگر به خواندن کامل این مطلب علاقهمندید، روی لینک مقابل کلیک کنید: dev community