خب بذارین یه داستان عجیب از یکی از بزرگترین رونماییهای اوپنایآی رو براتون بگم. همون روزی که حسابی سر و صدا کرده بودن واسه معرفی GPT-5، کلی اسلاید و گراف خفن نشون دادن تا قدرت مدل جدیدشون رو ثابت کنن. اما خب، اگه یکم دقیقتر به یکی از این چارتها نگاه میکردیم، فوری میفهمیدی یه چیزی این وسط درست نیست!

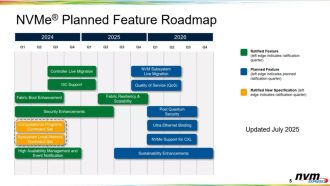

یکی از چارتهایی که خیلی توی برنامه بهش اشاره شد، در مورد اینکه GPT-5 چقدر تو “deception evals across models” عملکرد داره بود. بگذارین سادهتر بگم: این یعنی بررسی میکنن که مدل چقدر میتونه گول بزنه یا فریب بده—یه امتحان واسه سنجیدن راستگویی مدلهای هوش مصنوعی. حالا توی قسمت coding deception (فریب دادن تو بخش کدنویسی)، طبق همون چارت، نرخ فریب GPT-5 رو ۵۰٪ نوشته بودن. اما مقدار مدل o3 که ۴۷.۴ درصد بود، یه نوار گرافیکی بزرگتر از GPT-5 داشت! یعنی توی ظاهر گراف، انگار o3 از GPT-5 بدتر عمل کرده، ولی در واقعیت، اعداد اینو نشون نمیدادن.

جالب این جاست که همین آمارها توی وبلاگ رسمی اوپنایآی درست ارائه شده بودن! مثلاً توی همون بخش توی وبلاگ، نرخ فریب GPT-5 رو ۱۶.۵٪ زده بودن، نه ۵۰٪! یعنی یا توی کنفرانس یواشکی چارت رو عوض کرده بودن، یا یه اشتباه حسابی رخ داده بود.

این گاف عجیب گرافیکال باعث شد مردم توی توییتر (که حالا اسمش x هم هست!) هم کلی شوخی و طعنه کنن. یکی از کاربرا یه اسکرینشات گذاشت و نوشت: «کی این گرافهارو میسازه؟!» یکی دیگه هم نوشت: «این یکی از بدترین جنایات گرافیکیِ قرنه!»

حتی خود سم آلتمن، مدیرعامل اوپنایآی، توییت کرد و گفت که واقعاً تو چارتها اشکال پیش اومده و این رو «mega chart screwup» نامید! این یعنی اشتباه حسابی رو خود شرکت هم تایید کرد. البته بعدش گفتن که توی وبلاگشون چارت درستش رو گذاشتن. یک نفر از تیم مارکتینگ اوپنایآی هم اومد عذرخواهی کرد و گفت: «ببخشید بچهها، اشتباه چارت رو درست کردیم.»

یه توضیح کوچولو این وسط: وقتی میگن hallucination توی هوش مصنوعی، یعنی مدل، جوابایی میده یا ادعاهایی میکنه که اصلاً واقعیت نداره – انگار یه چیزی از خودش درمیاره! اوپنایآی توی همین مراسم حسابی از این گفت که GPT-5 تو کم کردن این خطاها کلی پیشرفت داشته، اما خب، با این چارتهای به هم ریخته، اعتماد به حرفاشون یه کم سخت شد!

در کل، چه این چارتها رو خود GPT-5 کشیده باشه یا نه، برای اوپنایآی اصلاً خوب نبود که توی روز بزرگ معرفی مدل جدیدش، همچین سوتی بزرگی بدن و باعث بشن کلی کاربر و خبرنگار بهشون گیر بدن. خلاصه، داستان امروز ما اینه که حتی قویترین شرکتهای هوش مصنوعی هم گاهی ممکنه توی سادهترین چیزها گاف بدن!

منبع: +