اگه فکر میکنی الان بازار هوش مصنوعی دیگه تهشه و OpenAI داره سقف تکنولوژی رو میزنه، باید بگم هنوز هیچی ندیدی! سم آلتمن، مدیرعامل OpenAI (همون شرکتی که ChatGPT رو ساخت)، یه رویای عجیبغریب داره: میخواد تا آخر امسال (۲۰۲۵ میلادی) تعداد کارت گرافیکهایی که شرکتش استفاده میکنه رو به بیشتر از ۱ میلیون برسونه. کارت گرافیک یا همون GPU یه جور قطعهست که تو پردازش هوش مصنوعی قدرت وحشتناکی به سیستمها میده—یه جورایی مغز ماشین یادگیریه.

جالب اینجاست که همین الانش OpenAI از رقباش کلی جلو افتاده. مثلاً شرکت xAI ایلان ماسک که مدل Grok 4 رو ساخته، یه چیزی حدود ۲۰۰ هزار تا GPU داره—یعنی OpenAI با ۱ میلیون عدد پنج برابر بیشتره! اما اینجا داستان تموم نمیشه. آلتمن با یه لحن بامزه گفت «خیلی به تیممون افتخار میکنم ولی حالا باید ۱۰۰ برابرش کنن!» (یعنی هدف بعدیش اینه که به ۱۰۰ میلیون کارت گرافیک برسه. واقعاً عدد عجیب و غریبیه…)

ولی خیلیا تو صنعت دارن جدی بررسی میکنن که این کار اصلاً شدنیه یا نه. چون اگه OpenAI بخواد ۱۰۰ میلیون GPU رو به کار بندازه، هزینهی تقریبیش میشه ۳ تریلیون دلار! (تریلیون یعنی هزار میلیارد—یه عدد که اگه صِفرهاشو بنویسی کدومتم حوصلهش نمیکنه!) تازه این هزینهش فقط نیست؛ ایرادهای سختافزاری، برق، فضا و حتی تاثیرش رو زیرساخت برق جهانی هم هست. این یعنی اگه واقعاً یه روز همچین اتفاقی بیفته، شاید کل زیرساختهای برق دنیا نیاز به تغییر اساسی پیدا کنن!

الان اکثر منابع پردازشی OpenAI روی پلتفرم آژور مایکروسافت اجرا میشه—آژور یه سرویس ابریه یعنی شرکتها میتونن تجهیزاتش رو اجاره کنن و نرمافزاراشون رو روش اجرا کنن—ولی OpenAI الان با Oracle هم قرارداد بسته و حتی گویا میخوان چیپهای شتابدهنده TPU گوگل رو هم تست کنن. TPU یه نوع شتابدهنده اختصاصی گوگله که قدرتش برای هوش مصنوعی خیلی بالاست.

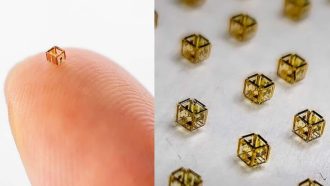

چیز جالبی که اینجا میشه گفت اینه که کل صنعت داره میره سمت این که خودش بره چیپ بسازه و دیگه به تولیدکنندههای خارجی وابسته نباشه. مثلاً Meta (همون فیسبوک سابق)، آمازون و خود گوگل دارن چیپهای خودشونو میسازن و از حافظه خاصی استفاده میکنن به اسم HBM. HBM یعنی High Bandwidth Memory—یعنی یه حافظه با ظرفیت انتقال اطلاعات خیلی بالا که کمک میکنه مدلهای هوش مصنوعی سریعتر آموزش ببینن.

اینجاست که شرکتهایی مثل SK Hynix سود زیادی میبرن! اونها سازنده همین حافظه HBM هستن و چون تقاضا داره میره بالا، کسبوکارشون هم حسابی رشد کرده. حتی پیشبینی کردن سودعملیاتی SK Hynix تو سهماهه دوم ۲۰۲۵ رکورد بزنه. همکاری OpenAI و SK Group هم داره قویتر میشه: رئیس و مدیرعامل SK Group یه مدت پیش با آلتمن دیدن کردن تا همکاری رو برای زیرساختهای هوش مصنوعی قویتر کنن. همین SK Telecom هم قبلاً رقابت هوش مصنوعی با ChatGPT رو برگزار کرده بود و کلی رو این فضا سرمایهگذاری کرده.

البته همه این جذابیتها یه نگرانیهایی هم داره. مثلاً این حجم گسترش باعث شده سرمایهگذارای بزرگی مثل SoftBank دوباره فکر کنن که اصلاً میخوان هنوز پول بریزن تو OpenAI یا نه. چون هزینهها چندین برابر شده و همه مطمئن نیستن OpenAI میتونه از پس خرجها و تکنولوژی لازم بربیاد.

ته داستان؟ فعلاً این هدف ۱۰۰ میلیونی بیشتر شبیه یه رویا و پزمه تا یه برنامه واقعی. ولی میشه اینو فهمید که OpenAI واقعا دنبال اینه که سطح قدرت پردازشیش رو چند ده برابر کنه و نشون بده همت و هدفش صرفاً رقابت با بقیه شرکتها نیست—میخواد دنیا رو یه پله آیندهدارتر کنه. حالا باید دید این مسیر پرخرج و سخت، اصلاً به نتیجه میرسه یا نه!

(راستی اگه علاقهمندی بدونی بهترین کارت گرافیکهای AMD چیا هستن یا دوست داری بهترین Mini PC ها رو بشناسی، یه سر به مقالههای معرفیشون بزن. ضمناً گوگل داره رو این کار میکنه که تو Gmail تبلیغهای قابل خرید بزنه، یعنی قراره اینباکسون پر از آگهی جورواجور بشه!)

منبع: +