امروز همه دارن درباره مدلهای زبانی بزرگ یا همون LLMها که میتونن داستان بنویسن، سوال جواب بدن یا حتی مسائل ریاضی رو حل کنن حرف میزنن. اما بگذار یه موضوع جالب رو برات باز کنم: چطور این مدلها میتونن توی چند مرحله به جواب مسائل پیچیده برسن و اگه جواباشون درست نبود، خودشون دوباره خودشون رو اصلاح کنن!

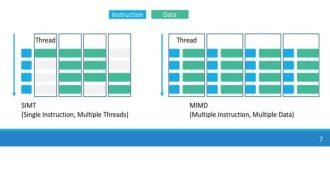

خب، تا حالا شنیدی Test-Time Scaling یا TTS؟ یعنی موقعی که مدل رو داری اجرا میکنی، با یه تکنیک خاص خروجیاش رو بهتر میکنی. مثلاً روش Best-of-N رو در نظر بگیر، یعنی مدل چند تا جواب مختلف تولید میکنه و بهترینش رو انتخاب میکنیم. یا Majority Voting، یعنی بین جوابها رأیگیری میشه و هر چی بیشترین رأی رو گرفت میگیم همونه! اما نکته اینجاست که اگه همه جوابها غلط باشن، این روشا کلاً بیفایدهست.

یه راه دیگه هم اینه که بیای و یه مدل جدا بسازی فقط برای اینکه جوابها رو بررسی کنه و بهترین رو انتخاب کنه. ولی خب این کار کلی هزینه و دردسر داره. الان یه تیم باهوش اومدن یه کار جالب کردن: گفتن چرا مدل خودش کار اصلاح رو انجام نده؟! یعنی مدل خودش تلاش کنه جوابای پیشنهادیش رو قشنگتر و درستتر کنه.

این کار جدید رو اسم گذاشتن Generative Self-Refinement یا به اختصار GSR، یعنی “خوداصلاحی مولد”. یعنی مدل اول چند تا پاسخ موازی درست میکنه، بعد خودش با نگاه به همون جوابها و مسئله اصلی، یه جواب درستتر و بهتر تولید میکنه. “مولد” هم یعنی مدل هر بار خودش یه خروجی جدید میسازه، نه اینکه از بین جوابهای قبلی انتخاب کنه.

البته یه مشکلی که داشتن این بود که همینجوری به مدل بگی “بیخیال قبلیا! خودتو اصلاح کن”، نمیتونه خیلی خوب اصلاح کنه! برای همین، اومدن یه فرایند یادگیری ریختن که دو تا هدف داشته باشه: یکی اینکه مدل یاد بگیره خودش مستقلاً جواب بده و یکی اینکه یاد بگیره جوابهای خودش رو بررسی و اصلاح کنه. ترکیب این دوتا باعث شد مدل تو هر دو کار قوی شه!

تو آزمایشهاشون هم اومدن پنج تا بنچمارک ریاضی (یعنی چندتا تست استاندارد و معروف برای سنجش حل مسئله ریاضی) رو امتحان کردن، دیدن نتیجهها عالیه و این روش GSR تونسته مدل رو بهترین تو این بنچمارکا کنه! حتی جالبتر اینکه این مهارت خوداصلاحی فقط مخصوص یه مدل خاص نیست؛ واسه مدلای کوچیک و بزرگ جواب داده و حتی تو مسائلی که مدل تا حالا ندیده هم خوب کار میکنه.

پس خلاصه بگم: تیم محققها اومدن یه روش دادن که خود مدلهای زبانی بتونن جوابهای خودشون رو هم نقد و هم اصلاح کنن، اونم بدون نیاز به مدل یا هزینه اضافه. این میتونه یه قدم بزرگ باشه تو هوشمندتر شدن مدلهایی که دیگه فقط حرف گوش نمیکنن، بلکه خودشون هم رو خودشون کار میکنن و بهتر میشن! (مدل اگاهمون داره مستقل میشه!)

منبع: +